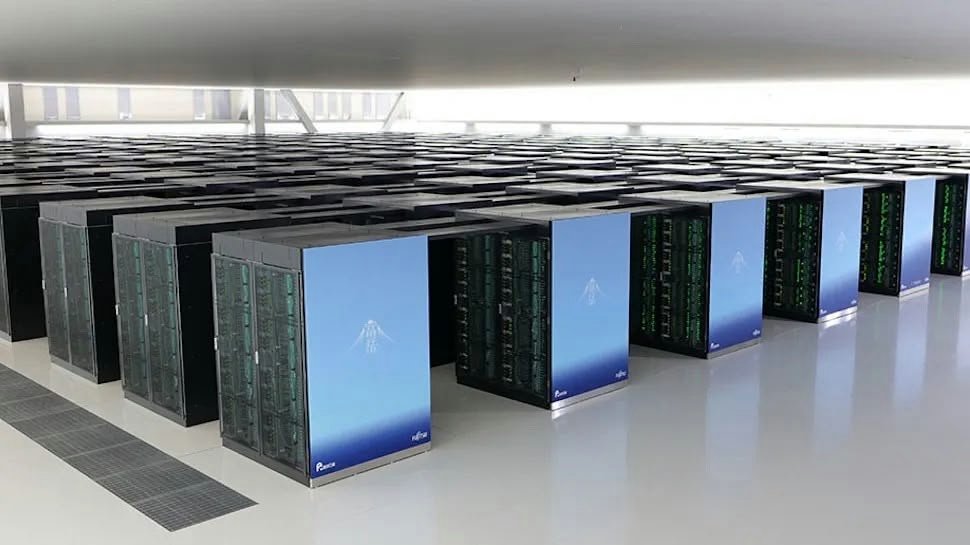

Cap sur une plateforme unifiée mêlant simulation et IA, avec des accélérateurs GPU intégrés pour la première fois dans un fleuron national du calcul japonais. L’hypothèse d’une participation de l’architecture « Feynman » de NVIDIA en fin de décennie circule prudemment au regard du calendrier.

- Le projet "FugakuNEXT" vise une performance IA de 600 000 pétaflops en FP8, combinant processeurs Fujitsu et GPU NVIDIA.

- Cette plateforme unifiée cherche à intégrer simulation scientifique et modèles génératifs pour des applications variées comme la santé et l'industrie.

- L'architecture hybride utilise des CPU Monaka-X et des interfaces NVLink pour maximiser la bande passante et l'efficacité énergétique.

Le projet « FugakuNEXT » ambitionne une performance IA d’environ 600 000 pétaflops en FP8, portée par une architecture hybride associant processeurs Fujitsu et accélérateurs NVIDIA. L’objectif est de marier calcul scientifique et modèles génératifs au sein d’une même pile logicielle et matérielle, de la physique numérique aux usages industriels.

Une puissance calibrée pour l’IA

L’ambition porte sur la performance IA en faible précision FP8, devenue la métrique clef pour mesurer le débit des réseaux de neurones, distincte des FLOPS en double précision traditionnellement utilisés pour le calcul scientifique. RIKEN évoque en parallèle un gain applicatif jusqu’à 100× par rapport à Fugaku, tout en restant dans une enveloppe voisine de ~40 MW, signe d’un effort d’efficacité énergétique à l’échelle système.

Au‑delà du chiffre, l’axe stratégique est d’unifier simulation et IA dans une même pile, pour mêler codes physiques et modèles génératifs au sein d’une plateforme partagée. Cette approche « AI‑HPC » cible des usages concrets, de la prévention des catastrophes à la découverte de médicaments et à l’optimisation industrielle, avec une intégration étroite du logiciel à l’infrastructure.

Techniquement, « 600 EFLOPS FP8 » n’équivaut pas à 600 EFLOPS en FP64 et traduit un débit maximal optimisé pour l’IA en précision 8 bits, souvent avec parcimonie (sparsity). Cela reste un saut d’échelle net face aux systèmes actuels, y compris ceux orientés IA annoncés récemment par les grands acteurs du calcul intensif.

Architecture : CPU Fujitsu et GPUs NVIDIA

Côté nœud, Fujitsu prépare des CPU Monaka‑X avec unités matricielles et extensions SIMD, pendant que NVIDIA fournit les accélérateurs et l’interconnect pour constituer une plateforme hybride. Selon les descriptions techniques publiées, l’interface NVLink Fusion relierait les CPU Monaka‑X aux GPU via NVSwitch, afin de partager la mémoire et maximiser la bande passante au sein du nœud.

L’empilement logiciel annoncé met l’accent sur la « précision mixte », pour maintenir la fidélité tout en accélérant drastiquement les temps de calcul. Ce schéma permet d’utiliser les tensor cores en FP8/FP16 pour le gros des opérations, tout en conservant des étapes sensibles en précision plus élevée lorsque nécessaire.

Le cap des 600 EFLOPS FP8 place d’emblée le projet au‑dessus des annonces publiques actuelles et confirme l’orientation IA des futures plateformes nationales de calcul scientifique. Pour le Japon, l’intégration étroite IA‑simulation est présentée comme un levier d’impact sociétal : préparation aux risques, santé, industrie… au‑delà des seuls records de performance.

Source : Tech Radar