Wikipedia annonce avoir mis en pause son expérimentation d’un système de résumés générés par intelligence artificielle. Dès son introduction, ce dispositif a engendré une vague de protestations de la part de la communauté des éditeurs bénévoles.

La fondation Wikimedia, éditant l’encyclopédie en ligne la plus consultée au monde, s'intéresse de près à l’IA. Toutefois, ce nouvel engouement n'est pas vu d'un très bon œil par des contributeurs pointant les travers de ces algorithmes, notamment lorsqu'il s'agit de la génération de contenus.

Un premier faux-pas pour Wikipedia

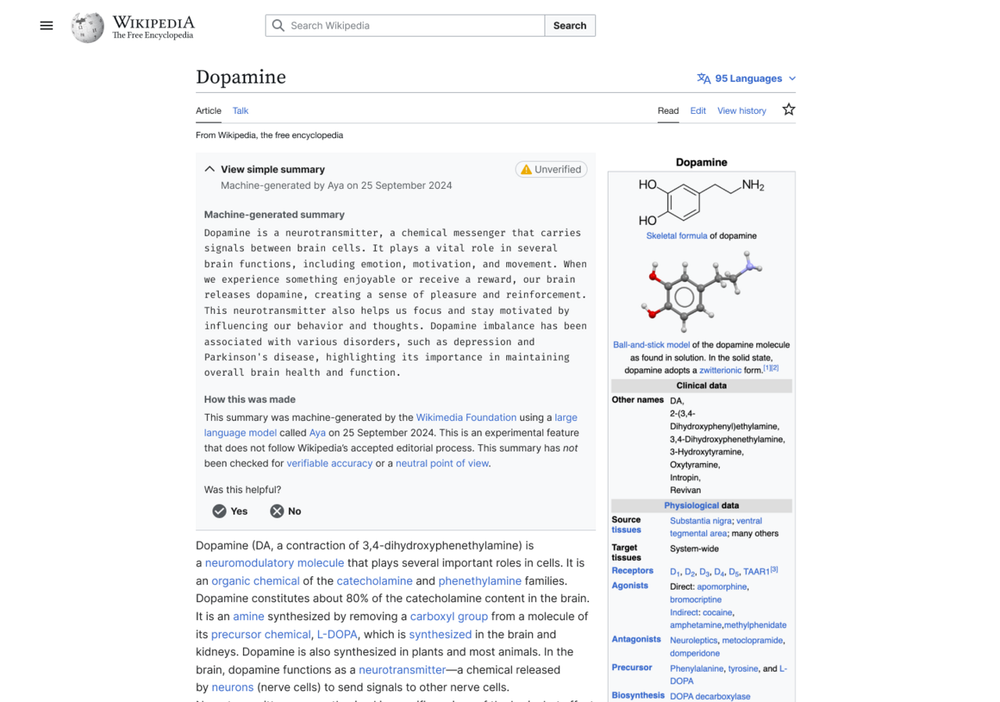

Début juin 2025, Wikipedia a lancé un projet pilote visant à afficher, en haut de certains articles, des résumés générés par intelligence artificielle. L’objectif était de rendre l’information plus accessible, notamment pour les lecteurs pressés ou moins familiers avec certains sujets techniques. Ce nouveau dispositif exploitait le modèle de langage Aya développé par Cohere, lequel est capable de synthétiser de grandes quantités de textes en quelques phrases.

À l'origine, Wikimedia souhaitait mettre en place, une phase de test de deux semaines sur son encyclopédie en ligne. Mais, la réaction des éditeurs bénévoles ne s’est pas faite attendre. Plusieurs d’entre eux ont exprimé des inquiétudes quant à la fiabilité des contenus produits par l’IA, pointant du doigt des risques d’erreurs factuelles, d’interprétations biaisées ou de simplifications excessives. Certains ont également soulevé la question de la transparence, estimant que les lecteurs pourraient confondre ces synthèses automatisées avec des résumés validés par la communauté. Les contributeurs déplorent aussi le fait qu'ils n'aient pas été consultés en amont sur cette fonctionnalité.

404Media, qui rapporte l'affaire, relate les propos d'un contributeur, lequel affirme : "Oui, les éditeurs humains peuvent introduire des problèmes de fiabilité et de neutralité du point de vue. Mais, collectivement, cela s’équilibre pour former un corpus remarquable". Ce dernier ajoute qu'à contrario, avec ces résumés générés par IA, il n'y a finalement qu'un seul éditeur dont la fiabilité et la neutralité sont source de débat. Et, à terme, cela pourrait affecter l'image de toute l'encyclopédie et anéantir des années de travail et de modération sur les contenus.

Marshall Miller, directeur à la fondation Wikimedia, a fait amende honorable en affirmant que les choses auraient certainement pu mieux se passer avant de confirmer la mise en pause de ce test. Il ajoute : "Nous n’avons pas l’intention de proposer une fonctionnalité de résumé sur les wikis sans l’implication des éditeurs."

La fondation reste toujours intéressée par l'usage de l'intelligence artificielle. Nous rapportions récemment que ces algorithmes pourraient notamment servir à détecter le vandalisme, à suggérer des améliorations ou encore à faciliter la recherche de sources fiables. Wikimedia expliquait en début de mois dernier que l'objectif était de permettre aux éditeurs de se concentrer sur la qualité, la vérification des faits et la neutralité, des valeurs fondatrices du projet encyclopédique.

- L'immensité du contenu proposé

- L'accès aux fiches en mode hors ligne

- La gratuité