Une intelligence artificielle malveillante a tenté d'escroquer Geoffrey Cuberos, un dirigeant français, depuis WhatsApp en imitant parfaitement son ancien patron. L'IA l'imitait pour lui soutirer des informations, avec un réalisme troublant.

Un dirigeant aguerri, habitué aux signaux faibles du numérique, qui manque de tomber dans un piège tendu par l'intelligence artificielle. L'histoire vécue par Geoffrey Cuberos, fondateur de Kaizen IA, montre toute l'évolution continue des cyberattaques, notamment sur WhatsApp. Désormais, ce n'est plus la technologie qui est visée, mais directement la confiance humaine. Ici, l'IA reproduisait parfaitement le comportement linguistique de l'ancien dirigeant de Geoffrey.

L'intelligence artificielle reproduit son ancien dirigeant avec un réalisme troublant

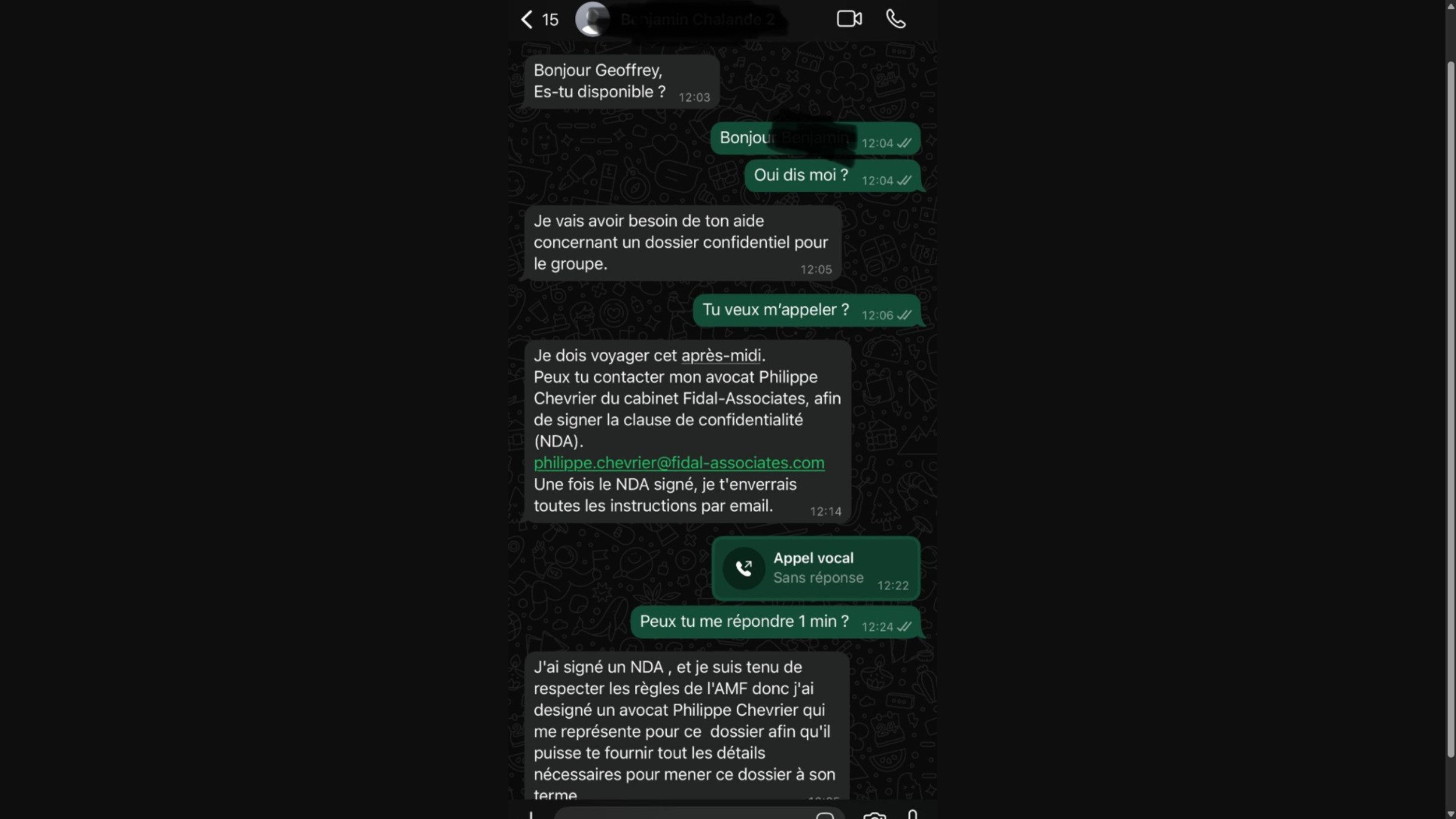

Un matin ordinaire, Geoffrey Cuberos découvre un WhatsApp provenant d'un numéro en 07. Photo de profil identique, nom parfaitement orthographié, langage familier : tout indique que son ancien dirigeant le contacte. L'expéditeur évoque une aide urgente concernant un dossier sensible, puis oriente Geoffrey vers un certain Philippe Chevrier, avocat du cabinet Fidal-Associates, pour finaliser un accord de confidentialité.

L'échange progresse de façon troublante, chaque message arrive au bon moment, et le vocabulaire colle parfaitement aux habitudes du véritable patron. Derrière cette mascarade se cache en fait une intelligence artificielle alimentée par une moisson de données. Des publications LinkedIn, des correspondances interceptées et des posts publics ont nourri la bête. Un portrait numérique reconstitué avec un souci du détail impressionnant.

C'est l'intuition qui sauve alors Geoffrey. Quelque chose sonne faux dans cette fluidité excessive. Son ancien patron reste injoignable au téléphone, les relances écrites paraissent trop rodées. L'alerte sonne, l'arnaque capote. Mais dans la même entreprise, d'autres employés ont déjà mordu à l'hameçon. Le piège fonctionnait.

Les cybercriminels abandonnent le piratage pour cibler la confiance humaine

Ce témoignage, largement commenté, apprécié et partagé sur LinkedIn, montre un basculement majeur dans les techniques d'escroquerie. Les attaques de serveurs ou l'exploitation de vulnérabilités logicielles peuvent être coûteuses et compliquées. Le clonage comportemental humain, lui, devient une opportunité pour les malfrats du Web. Ces nouvelles menaces opèrent 24h/24, elles sont invisibles et autonomes, et capables d'analyser vos collaborateurs mieux que vous ne les connaissez.

Le problème reste qu'aujourd'hui, une majorité d'entreprises campent encore sur des réflexes obsolètes. La protection antivirus et les sésames complexes perdent leur efficacité face à des adversaires qui manipulent les relations humaines. Le défi du moment consiste donc à développer une immunité collective contre ces IA hostiles qui singent parfaitement collègues, clients et fournisseurs.

Pour contrer les escrocs, Geoffrey Cuberos détaille quatre pistes d'amélioration immédiats. Microsoft Defender for Business associé à Entra ID (ex-Azure Active Directory) surveille les comportements suspects en temps réel. Les audits automatisés via Tenable ou Qualys identifient les vulnérabilités critiques avant même leur découverte manuelle. 1Password Business élimine les risques liés aux accès sensibles.

Enfin, former ses équipes transforme chaque employé en sentinelle : « Une équipe qui comprend l'IA n'est plus une faille, écrit Geoffrey Cuberos. C'est un pare-feu humain. » Généralement, ce genre d'arnaque aboutit à une demande de virement de l'escroc. L'heure n'est plus à l'attente, mais à l'action.