Pourtant, si les problèmes d'affichage que cherche à corriger G-Sync sont les mêmes quel que soit le support, et si sur le principe le palliatif reste identique, les moyens diffèrent quelque peu.

Il nous faudra donc vous faire un petit rappel théorique avant de passer à la pratique et de vérifier plusieurs points : G-Sync mobile fonctionne-t-il correctement, sous quelles conditions, et avec quel est l'impact sur les performances.

G-Sync, rappels

Tous les joueurs PC le savent : ils ont un choix à faire entre tirer le meilleur parti de leur matériel pour afficher un maximum d'images par seconde, quitte à subir le phénomène de déchirement (ou tearing en anglais), ou bien activer la synchronisation verticale pour supprimer ce type d'artefact, mais récupérer en contrepartie des saccades ou du lag (retard d'affichage) et se trouver limité en matière de fps.

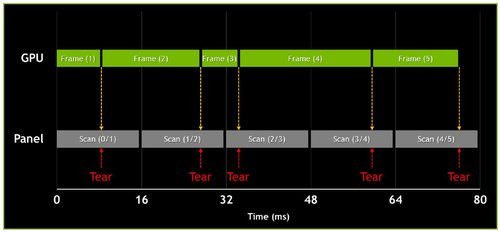

Les images envoyées par la carte graphique s'enchaînent selon le rythme imposé par la carte graphique, qui ne correspond pas à celui de l'écran

Lorsque V-Sync est activé, le tempo d'affichage est dicté par l'écran, ce qui peut occasionner saccades et lag. Ici, la première image « scan 1 » est répétée deux fois (saccades) alors que la troisième image est retardée, ce qui occasionne un lag.

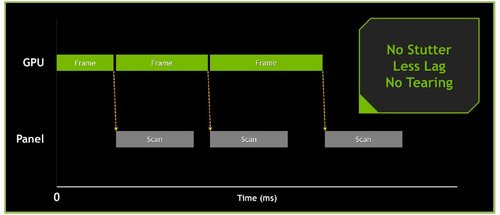

C'est à ce cruel dilemme que NVIDIA s'est attaqué il y a environ 18 mois avec G-Sync. L'idée de cette technologie : supprimer la source de tous les maux, c'est-à-dire la différence entre le taux de rafraîchissement des moniteurs et la vitesse de rendu des images des cartes graphiques. Et là où la V-Sync propose de caler la carte graphique sur le moniteur à taux de rafraîchissement fixe (le plus souvent à 60 Hz), G-Sync prend une autre voie, celle où c'est la carte graphique qui dicte sa loi.

En activant G-Sync, vous évitez à la fois le déchirement et réduisez les chances d'observer des saccades. Le beurre et l'argent du beurre en somme. Pour ce faire, la carte graphique va communiquer avec le moniteur pour adapter la fréquence d'affichage de ce dernier au flux d'image qu'elle génère. G-Sync nécessite donc des écrans capables de taux de rafraîchissement variables.

Pour parvenir à ce résultat, NVIDIA avait introduit un scaler de son cru dans les écrans de ses partenaires, afin que ces périphériques puissent communiquer avec la carte graphique. Sur un PC portable, l'histoire est légèrement différente.

Cette fois, pas de scaler

Un ordinateur portable diffère d'une machine desktop en cela qu'il a une contrainte supplémentaire, et non des moindres : celle de l'économie d'énergie. C'est en prenant en compte ce paramètre que la VESA (pour Video Electronics Standards Association) a fait en sorte que le DisplayPort interne (ou embedded DisplayPort, ou encore eDP) puissent gérer des taux de rafraîchissement variable et ce, depuis 2008 et la version 1.0 de l'eDP. Sur portable, pas besoin de scaler, donc.

Corollaire : depuis 2008, G-Sync pouvait en théorie tout à fait fonctionner sur un portable. Un utilisateur a avait d'ailleurs apporté la preuve au début de cette année (voir Bientôt du G-Sync sur PC portable ?). Pourtant, il a fallu attendre le mois de mai pour voir arriver la technologie NVIDIA sur portable. Pourquoi ? Pour le caméléon, les dalles n'étaient pas prêtes, et la fréquence de renouvellement des gammes fait qu'il était difficile de faire plus vite.

Difficile de ne pas entrer dans des considérations ayant trait à la politique de l'entreprise, et à la façon dont NVIDIA a géré la concurrence du FreeSync poussé par AMD. Du fait de sa position dominante sur le marché des portables disposant d'un GPU dédié, on peut supposer que NVIDIA a pu tenter une approche qui aurait généré plus de bénéfices que ceux produits par la certification que le caméléon donne aux constructeurs.

Les GeForce présentes dans les portables estampillés G-Sync ne sont donc pas différentes des autres, et aucune puce supplémentaire n'est ajoutée. NVIDIA valide simplement le choix de la dalle, cette dernière devant disposer de caractéristiques techniques à même de tirer au maximum parti de sa technologie.

G-Sync mobile : tout est dans la dalle

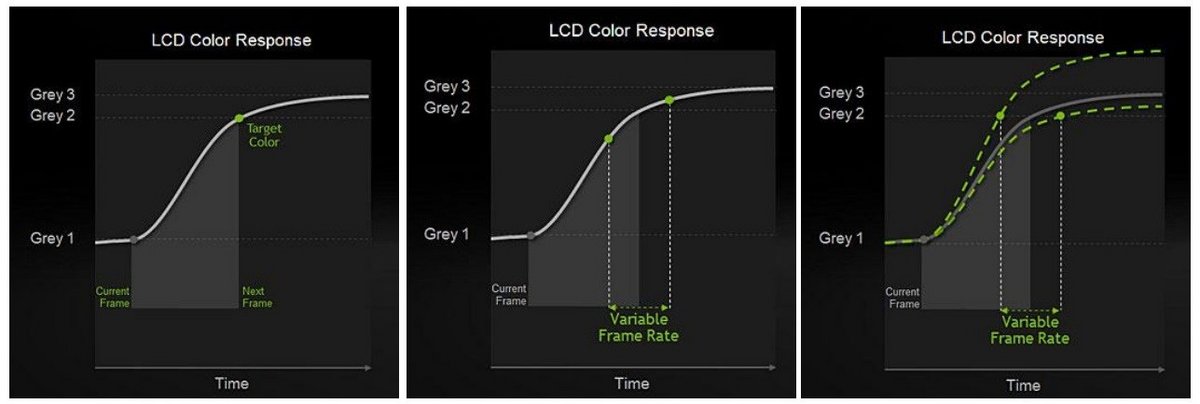

NVIDIA n'est évidemment pas très loquace quant aux recommandations envoyées aux constructeurs pour leurs dalles. Pas plus qu'elle ne l'est lorsqu'il s'agit d'évoquer les royalties réclamées aux constructeurs pour la certification G-Sync. En revanche, le caméléon nous a tout de même renseignés sur les qualités nécessaires à une dalle validée par leurs soins.En plus d'être réactive et de pouvoir afficher « de magnifiques couleurs » (sans apporter plus d'informations), NVIDIA exige des OEM qu'ils équipent leurs machines de dalles capables de supporter des transitions entre niveaux de couleurs ou de gris à gris plus rapides, et surtout avec des taux de rafraîchissement variables.

L'overdrive de ces écrans (puisque c'est ce type de technologie dont il s'agit) existe depuis longtemps sur les écrans dont le taux de rafraîchissement est fixe. Pour gérer ce nouveau paramètre, NVIDIA use d'algorithmes spécifiques que les dalles doivent être à même de supporter. L'origine de cette exigence se trouve dans la volonté de NVIDIA d'éviter le phénomène de ghosting que l'on observe notamment sur les premiers écrans... FreeSync, artefact que nous avons remarqué par nos soins. Une façon de se démarquer de la technologie que tente de démocratiser AMD, le concurrent de toujours.

Enfin, s'il n'existe pas de dalles 144 Hz comme c'est le cas sur desktop, l'arrivée de G-Sync mobile a le mérite de faire évoluer les dalles sur portables. NVIDIA a ainsi annoncé une série de modèles déjà prêts pour G-Sync mobile, chez Gigabyte (Aorus X7 Pro-SYNC, Aorus X5), MSI (GT72 G), Asus (G751JY GSYNC, G751JT GSYNC) ou Clevo (P770ZM-G et P750ZM-G). Tous sont équipés de GeForce GTX 965M, 970M, 980M (les seules habilitées à utiliser G-Sync mobile) et disposent de dalles capables d'afficher 75 images par seconde.

L'intérêt du 75 Hz, c'est que même G-Sync activé, vous n'êtes plus limités à 60 Hz. Un écran ne peut aller au-delà de ses spécifications techniques. Avec G-Sync (ou V-Sync), une dalle de 60 Hz ne pourra jamais afficher plus de 60 fps, alors même que votre carte graphique le permet.

Pourquoi ne pas avoir imposé de dalles 120 Hz, comme il en existe sur les portables compatibles 3D Vision ? D'après NVIDIA, ce choix n'est pas forcément pertinent puisque les consommateurs qui se soucient des soucis d'affichage comme le déchirement sont ceux qui poussent les niveaux de détails et jouent aux titres récents. Dans ces conditions, il n'existe à ce jour aucune carte qui puisse afficher 120 fps. Et puisqu'un portable gamer est en principe conservé quelques années, cela sera d'autant plus vrai sur les futurs jeux auxquels il sera confronté.

Un argument qui se défend. Notre avis, c'est qu'une dalle 120 Hz a un coût non négligeable que NVIDIA ne voulait pas imposer aux OEM, ces derniers s'acquittant déjà de la dîme que leur prélève le caméléon. Cette participation aux R&D de NVIDIA associée au surcoût engendré par la dalle de qualité supérieure exigée impliquent un prix supérieur de 50 à 100 dollars selon les machines. Sans doute que ni NVIDIA, ni les constructeurs ne souhaitaient voir les tarifs s'envoler.

Optimus : par ici la sortie !

La théorie, c'est fait ; qu'en est-il dans la pratique ? La première observation concernant G-Sync mobile, c'est que cette technologie en chasse une autre. Au revoir donc Optimus, cette fonctionnalité qui permettait de passer d'un GPU dédié signé du caméléon à l'IGP embarqué par le processeur.Sachant que l'écran communique exclusivement avec la carte NVIDIA afin de caler ses fréquences en fonction de ce que lui envoie le processeur graphique, impossible pour la dalle d'être connectée à l'IGP. À moins de câbler en conséquence et de faire en sorte qu'Optimus reprenne la main dès lors que G-Sync est désactivé.

Nous ne savons pas si Optimus en est capable, d'une part, et nous doutons fortement que sur des portables pour joueurs, les OEM s'amusent à complexifier encore le câblage. D'autant que certains d'entre eux avaient d'ores et déjà abandonné Optimus. Cette technologie est donc bel et bien absente des portables G-Sync.

Est-ce un mal ? Sans doute. Car certains portables pour joueurs commencent à miser sur la mobilité, comme c'est le cas chez Gigabyte, qui travaille en ce sens avec sa filiale Aorus. Et NVIDIA, avec son Battery Boost, semble également croire à cette tendance.

Quoi qu'il arrive, la perte d'autonomie engendrée par cette absence est sans doute non négligeable, et cantonne les machines G-Sync à un rôle de desktop replacement, c'est-à-dire des portables qui ne pourront pas être utilisées loin d'une prise de courant.

G-Sync : efficace, sous certaines conditions

Pour évaluer ce que vaut G-Sync sur un portable, nous avons reçu de la part de MSI l'une des leurs récentes machines, le MSI GT Series GT72 Dominator Pro G. Ce portable est équipé d'un Intel Core i7-5700HQ de cinquième génération, de 16 Go de mémoire vive, d'un SSD de 256 Go associé à un disque dur de 1 To, et surtout d'une GeForce GTX 980M.

Nous avons effectué nos tests sur quatre titres récents : Project Cars, Far Cry 4, Crysis 3 et The Witcher 3. Premier constat : comme sous G-Sync version desktop, il faut absolument activer G-Sync avant de lancer un jeu, sans quoi l'option n'est pas prise en compte. Second point : G-Sync mobile profite des dernières avancées de NVIDIA sur sa technologie, puisque le mode fenêtré est disponible.

Qu'en est-il ensuite de nos impressions ? Clairement, G-Sync fonctionne tout aussi bien sur portable que sur un PC de bureau. Le phénomène de déchirement et les saccades sont bel et bien éliminés, et par rapport à V-Sync, les lags sont effectivement plus rares. Le résultat est à la hauteur : l'expérience en jeu est plaisante, tout simplement.

Évidemment, G-Sync conserve tout de même quelques limitations. Lorsque nous avons utilisé des réglages qui permettaient à la puissante GTX 980M d'envoyer plus de 75 Hz, le gain de confort par rapport à V-Sync nous a semblé somme toute assez limité. Présent, mais limité. Là où G-Sync est le plus intéressant, c'est justement lorsque le nombre d'images à afficher se situe entre les deux limites de fréquences de l'écran, que l'on peut estimer ici à 30-35 Hz et 75 Hz.

Étant donnée la carte graphique mise entre nos mains, il nous a donc fallu pousser les niveaux de détails un peu plus hauts, afin de rester dans cette gamme de fréquences. Dans ces conditions, le nombre de lags observés sous G-Sync est très faible, là où il reste notable sous V-Sync, particulièrement sur Crysis 3 ou Far Cry 4. The Witcher 3 n'a pas livré le même verdict, et il nous a été bien compliqué d'observer une différence entre G-Sync et V-Sync. Il en fut de même sous Project : Cars qui, par sa nature (simulation automobile), n'a pas non plus mis en évidence une différence majeure entre les deux technologies.

V-Sync, G-Sync : impact sur les performances

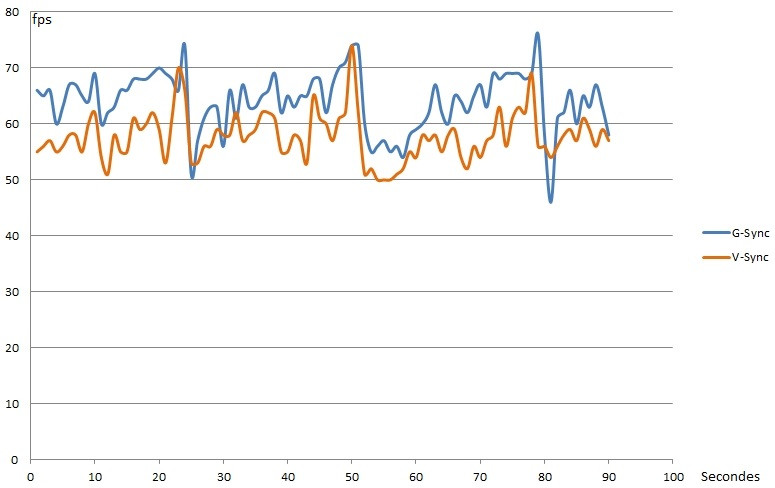

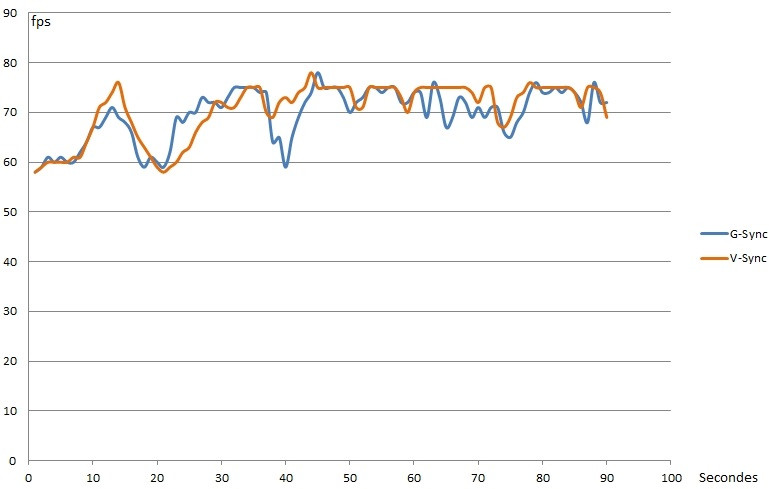

À l'œil, il nous a donc été parfois difficile de départager V-Sync de G-Sync, du moins sur certains jeux. Qu'en est-il de l'impact de ces deux technologies sur les performances ? Pour le savoir, nous avons mesuré le nombre d'images par seconde générées sur nos quatre jeux, sur une scène reproductible, et durant 90 secondes. FRAPS nous fournit un log du nombre de fps que nous exploitons ensuite sous Excel. Voici les graphiques obtenus.Crysis 3

Crysis 3 semble particulièrement profiter de G-Sync, puisque l'écart de performances par rapport à V-Sync est notable. Sur une bonne partie de notre scène, la différence entre les deux technologies est bel et bien visible, à l'avantage de la technologie NVIDIA qui semble moins sacrifier les performances que ne le fait V-Sync.

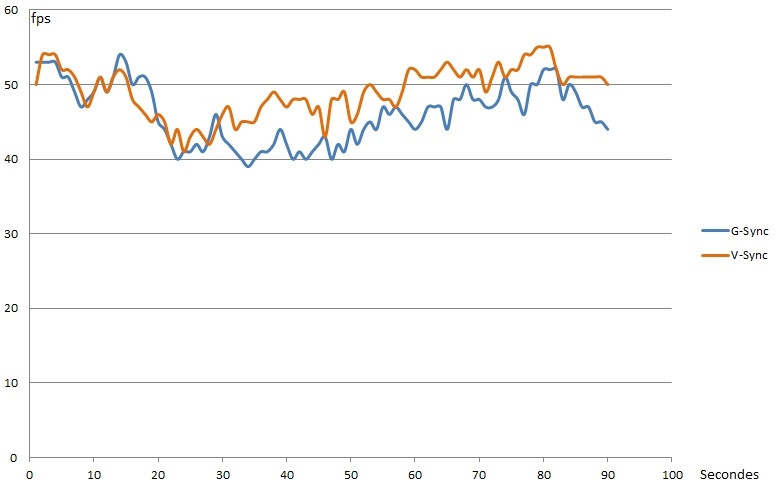

Far Cry 4

Ce qui est vrai sous Crysis 3 ne l'est pas sous Far Cry 4, puisqu'on constate un comportement presque inversé. Là, c'est V-Sync qui conserve le mieux les performances. Nous avons vérifié ce résultat en prenant soin d'éviter tout phénomène d'abaissement de fréquences, que ce soit au niveau du GPU ou à celui du GPU.

Project : Cars

Project : Cars n'a pas révélé visuellement de différences notables entre V-Sync et G-Sync : ce n'est pas le cas non plus au niveau des performances. Les deux courbes sont en effet ici très proches, et aucune des deux technologies ne se détache.

The Witcher 3

Le constat est identique sous The Witcher 3 : mis en part en fin de séquence où G-Sync l'emporte, impossible d'établir un gagnant sur ce test. Évidemment, nous avons mené nos tests sur des scènes précises, et il serait prétentieux d'étendre ces conclusions à l'ensemble de ces titres, et a fortiori à l'ensemble des jeux, d'autant que l'on observe des différences selon le titre utilisé. Ces résultats sont donc à prendre avec précaution, mais conserve valeur d'exemples.

Conclusion

G-Sync avait déjà convaincu sur PC de bureau. Sur portable, le constat est similaire. Certes, cette technologie ne sera pas utile à tous et vise en priorité les joueurs les plus exigeants. D'ailleurs, le fait de réserver G-Sync aux seules GTX 965M, 970M et 980M est un signe qui ne trompe pas.D'après nos tests, G-Sync ne dispose que d'un faible avantage par rapport à V-Sync lorsque la fréquence d'images générées atteint ou dépasse les 75 unités par seconde. Certes. Cependant, il y a de multiples raisons qui peuvent abaisser le nombre de fps sous cette limite déjà élevée. La qualité graphique en premier lieu, mais aussi le fait de jouer en réseau dans une LAN, par exemple.

G-Sync parait même à ce titre plus pertinent sur mobile que sur desktop, puisque le frame rate y est souvent moins élevé. En un mot comme en cent, G-Sync sur portable est donc une réussite. À une exception près : la disparition d'Optimus des portables équipés de la dernière technologie de NVIDIA.

Certains ne verront pas là un inconvénient, partant du principe qu'un portable gamer n'a pas pour vocation à être utilisé loin d'une prise de courant. Ce serait nier les récents efforts des constructeurs et même de NVIDIA pour promouvoir le jeu nomade, qui reste une tendance du moment et un potentiel levier de croissance pour l'industrie.