Après avoir secoué la Silicon Valley, l'agent IA autonome OpenClaw débarque sur nos machines. Promesse d'un assistant omniscient ou cauchemar de cybersécurité ? De l'installation sur un vieux PC à la configuration blindée sur VPS, voici comment dompter la bête sans sacrifier votre vie privée.

Mis à jour le 10 mars 2026 : ajout d'un avertissement sur l'utilisation d'un abonnement Claude Pro ou Max avec OpenClaw.

Si vous avez lu mon précédent article sur ClawdBot, vous savez qu'OpenClaw (anciennement ClawdBot, renommé suite à quelques frictions juridiques avec Anthropic) n'est pas un énième chatbot passif. C'est un agent. Un vrai. Il ne se contente pas de répondre : il agit, exécute du code et prend des initiatives. Mieux encore : il code ses propres fonctionnalités. Quand je lui ai demandé s'il était possible de discuter en conversation vocale, il a cherché les API disponibles, écrit l'intégration, configuré le service — et dix minutes plus tard, ça fonctionnait. Sans que je touche une seule ligne de code.

Depuis, le projet a littéralement explosé : plus de 250 000 étoiles sur GitHub, premier projet logiciel de l'histoire de la plateforme à dépasser React et Linux. En trois semaines, il a dépassé le niveau d'adoption que Linux a mis 30 ans à atteindre. Jensen Huang, le patron de NVIDIA, l'a résumé mieux que personne lors de la conférence Morgan Stanley TMT :

« C'est probablement la sortie logicielle la plus importante de tous les temps. »

— Jensen Huang, CEO de NVIDIA

Rien que ça. Il matérialise enfin le fantasme de l'assistant personnel type « J.A.R.V.I.S » qui vit sur votre machine — avec les nuances qu'on détaillera plus bas. D'ailleurs, OpenAI a senti le vent tourner et a tout simplement débauché le créateur d'OpenClaw il y a quelques semaines.

Message à ceux qui commenteront sans avoir lu l'article

Oui, c'est une IA qui a accès à votre machine. Non, elle ne va pas « prendre le contrôle ». Oui, ça dépend d'une API cloud (sauf si vous choisissez un modèle 100 % local, ce que le guide explique). Non, ça ne va pas vous rendre idiot — pas plus qu'Excel n'a rendu les comptables idiots. Oui, il y a des risques de sécurité, et on y consacre une section entière. Non, ce n'est pas réservé aux développeurs barbus sous Arch Linux.

J'ai hésité à écrire cet article. Honnêtement, après des dizaines d'heures à configurer, casser, reconfigurer, re-casser et finalement dompter cet outil, j'avais un peu l'impression de livrer ma « secret sauce » sur un plateau d'argent. Puis je me suis dit que si je ne le faisais pas, quelqu'un d'autre le ferait — mais en moins bien.

Mais ne nous mentons pas : donner un accès shell complet à une IA, même basée sur les excellents modèles de Claude ou OpenAI, relève du sport extrême numérique. Vous voulez tenter l'expérience ? Parfait. Mais pas n'importe comment. J'ai compilé la méthode la plus fiable pour installer, configurer et surtout verrouiller OpenClaw, que vous soyez sous Windows, macOS ou Linux.

Laissez-moi vous convaincre

Avant de plonger dans l'installation, voici quelques exemples de ce que j'ai mis en place en quelques jours :

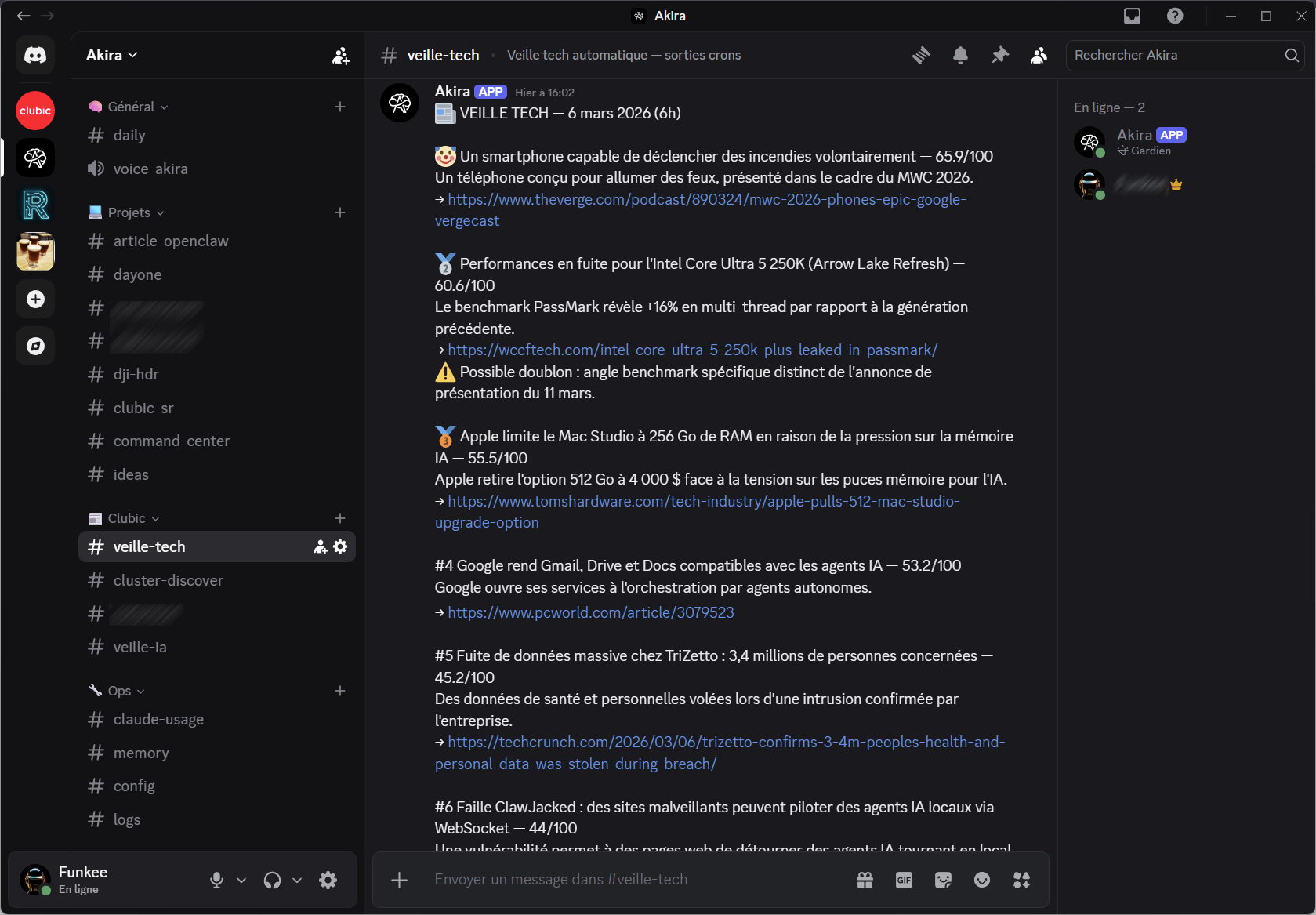

- Un bot disponible 24h/24 via Discord : un serveur privé avec des channels dédiés par projet, par sujet, par type de tâche. Je lui parle depuis mon téléphone, mon PC, n'importe où.

- Une veille tech et IA automatisée : chaque matin, l'agent scrape 41 flux RSS, Reddit, X/Twitter et Google News, déduplique, score les sujets par pertinence, et m'envoie un briefing classé sur Discord.

- Un détecteur de clusters Google Discover : quand trois sources ou plus publient sur le même sujet en moins de deux heures, l'agent me notifie. Signal fort qu'un sujet va exploser.

- Le monitoring de mes projets GitHub : git status, alertes sur les builds cassés, suivi des PR — sans ouvrir un navigateur.

- Un agent vocal : via ElevenLabs, je parle à mon Mac Mini et il me répond. Même contexte que Discord, conversation fluide.

- La gestion de mon calendrier et de mes emails : Google Calendar, Gmail — l'agent résume mes non-lus, me rappelle les rendez-vous, signale les urgences.

- L'interprétation d'images : vous galérez sur un message d'erreur, un graphique bizarre, un schéma technique ? Envoyez un screenshot, l'agent le voit et vous aide. Pas besoin de décrire le problème, il analyse l'image directement.

- Les messages vocaux : la flemme de taper ? Envoyez un vocal depuis Discord ou Telegram, l'agent le transcrit et répond. Il peut aussi vous répondre en vocal.

- Un backup automatique quotidien : commit et push de tout le workspace vers un repo privé. Si la machine crame, je récupère tout en dix minutes. Oui, j'ai testé. Non, pas volontairement.

- Un mode proactif : j'alloue une partie de mes tokens à des tâches de fond — organisation de la mémoire, vérification de l'état des projets, idées d'amélioration. Il m'est arrivé de me réveiller avec des suggestions pertinentes que je n'avais pas demandées. C'est un peu comme avoir un stagiaire qui bosse la nuit — sauf qu'il ne se plaint pas et qu'il n'a jamais la gueule de bois.

Tout ça depuis Discord, Telegram, ou n'importe quel canal de messagerie que vous configurez. Sans ouvrir votre ordinateur.

Mais pourquoi ne pas juste utiliser ChatGPT ou Claude.ai ?

C'est la question légitime. ChatGPT et Claude.ai sont excellents pour ce qu'ils font : vous posez une question, ils répondent. Mais c'est un dialogue passif : vous devez être devant l'écran, taper votre message, attendre la réponse, relancer.

OpenClaw, c'est un agent. Il a accès à votre système de fichiers, votre terminal, votre navigateur, vos API. Il peut agir sans vous : lancer un script à 3h du matin, vérifier vos e-mails toutes les heures, monitorer vos builds, vous envoyer un résumé sur Discord pendant que vous dormez. Il a une mémoire persistante : il sait qui vous êtes, quels sont vos projets, ce que vous lui avez dit il y a trois semaines. Et il s'améliore au fil du temps, parce que vous enrichissez ses fichiers de contexte.

ChatGPT, c'est un interlocuteur. OpenClaw, c'est un collaborateur. La différence, c'est l'autonomie.

Le concept a d'ailleurs convaincu au-delà de la communauté open source : Microsoft a lancé Copilot Tasks, sa propre réponse à OpenClaw, intégrée à l'écosystème Microsoft 365. La différence : Copilot Tasks tourne dans le cloud de Microsoft, pas chez vous. À vous de voir si c'est un avantage ou un inconvénient.

À qui s'adresse ce guide ?

OpenClaw est un outil expérimental. Puissant, mais expérimental. Ce guide essaie de rendre l'installation aussi accessible que possible, mais soyons clairs : vous aurez besoin d'ouvrir un terminal. Pas pour coder — juste pour lancer l'installation (une ligne à copier-coller), et ponctuellement pour les commandes de maintenance.

Une fois installé, tout passe par votre messagerie : Discord, Telegram, WhatsApp… plus besoin du terminal au quotidien.

Si copier-coller une commande dans un terminal vous semble faisable, ce guide est fait pour vous. Vous n'avez pas besoin d'être développeur. Le reste, c'est votre agent qui s'en chargera. Comptez 15-30 minutes pour une installation fonctionnelle (install + onboarding + premier message). Une à deux heures si vous voulez configurer Discord, les crons et les fichiers de mémoire correctement. Et quelques jours d'usage pour que l'agent commence vraiment à vous connaître.

Et si vous bloquez à n'importe quelle étape, collez l'erreur dans ChatGPT, Claude ou Gemini — ils savent tous débugger une installation Node.js et OpenClaw.

Un aveu avant de commencer : tout ce que vous allez lire dans ce guide : la hiérarchie des modèles, les crons, la mémoire, les channels, les hard rules ; vous n'avez techniquement pas besoin de le configurer vous-même. Une fois OpenClaw installé, vous pouvez simplement lui dire « configure-moi un fallback local avec Ollama » ou « mets en place une veille tech tous les matins à 9h sur Discord » et il le fait. En français, sans commande, sans éditer un fichier. Ce guide vous explique les concepts pour que vous sachiez quoi demander et pourquoi. La mise en place, c'est votre agent qui s'en charge.

Combien ça coûte ?

OpenClaw lui-même est gratuit et open source. Ce qui coûte, c'est le modèle IA que vous branchez dessus. Trois approches :

- L'abonnement fixe — la plus simple.

Un abonnementClaudePro (~18 €/mois) ou Claude Max (~90 € ou ~185 €/mois selon le palier) vous donne un quota mensuel de tokens sans surprise(voir encadré ci-dessous). C'est ce que je recommande pour commencer : budget prévisible, pas de mauvaise surprise en fin de mois. ChatGPT Plus (~22 €/mois) fonctionne très bien. - L'API à l'usage — plus flexible, mais la facture peut monter. Vous payez au token consommé. En usage quotidien modéré (conversations, quelques automatisations), comptez entre 5 et 30 € par mois. En usage intensif avec un modèle haut de gamme comme Opus, ça peut grimper à 100-150 € sans optimisation. Les heartbeats, les crons, les sous-agents — tout consomme des tokens.

- Le tout gratuit — c'est possible. Google offre un quota API Gemini généreux (250 000 tokens par jour, gratuit). Ollama fait tourner des modèles locaux sans aucun coût au-delà de l'électricité. C'est moins puissant qu'Opus ou GPT-5, mais c'est fonctionnel. Comme une Dacia Sandero : ça vous emmène d'un point A à un point B, et ça ne vous ruinera pas à la pompe.

Le coût de la machine elle-même : rien si vous utilisez votre PC principal. 5-10 €/mois pour un VPS. 150-300 € une fois pour un Mac Mini d'occasion.

🚨Anthropic bloque désormais les tokens OAuth des abonnements Claude (Free, Pro, Max) en dehors de Claude Code et claude.ai. Si vous comptiez récupérer votre token via le setup Claude Code pour alimenter OpenClaw, c'est mort, message d'erreur garanti. Google a été encore plus radical : bans secs de comptes AI Ultra à 250 $/mois, parfois avec des effets de cascade sur Gmail et Drive. Seule OpenAI tolère encore l'OAuth, sans doute grâce au recrutement de Peter Steinberger. Pour OpenClaw avec Claude, la seule voie viable et conforme aux ToS, c'est la clé API via console.anthropic.com. Plus cher en usage intensif, mais personne ne vous coupera le robinet au réveil.

PC principal ou machine dédiée ?

La question se pose, surtout si vous voulez quelque chose de toujours disponible.

Sur votre machine principale, OpenClaw s'installe en daemon (launchd sur macOS, systemd sur Linux). Il démarre au boot, tourne en arrière-plan, consomme quasiment rien au repos. C'est la config la plus simple pour commencer. Le seul inconvénient : si votre machine dort ou s'éteint, l'agent dort aussi.

Sur un Mac Mini, un NUC ou un petit PC dédié, vous avez un agent 24h/24, 7j/7. Idéal si vous voulez de la réactivité à toute heure : un email urgent à 3h du matin, un monitoring de build qui doit vous alerter immédiatement. Comptez 150-300 € pour une machine d'occasion largement suffisante. Un Mac Mini M2 avec 8 Go de RAM fait parfaitement l'affaire.

Sur un VPS (Hetzner, OVH, etc.), c'est la solution la moins chère pour du 24/7 (5-10 €/mois), mais vous perdez l'accès au système de fichiers local, à la caméra, au screen recording. C'est suffisant pour un usage messagerie/veille/monitoring, pas pour piloter des applis locales.

Sur un Raspberry Pi 5 (4 Go RAM minimum), ça tourne. Avec une API distante (Anthropic, OpenAI…), les réponses sont rapides, le Pi ne fait que relayer.

Le cas du Mac Mini M4 Pro

Ce n'est pas un hasard si Apple nous a prêté un Mac Mini M4 Pro avec 48 Go de mémoire unifiée pour les besoins de cet article (merci à eux). Depuis le lancement d'OpenClaw, le Mac Mini est devenu la machine de référence pour héberger un agent IA personnel. À tel point que les modèles haute mémoire (24 et 32 Go) affichent deux à trois semaines de délai de livraison sur l'Apple Store américain, et que les Mac Studio 64/128 Go sont passés de 14 à 54 jours d'attente en un mois, selon TechRadar. Business Insider parle carrément d'un « moment Mac Mini » porté par la vague OpenClaw.

Pourquoi le Mac Mini spécifiquement ? Le format compact (il tient dans une main), la consommation au repos ridicule (~10 W), le Neural Engine d'Apple Silicon, et surtout l'architecture mémoire unifiée — 48 Go de RAM partagés entre le CPU et le GPU, ce qui permet de faire tourner des modèles locaux de 35 milliards de paramètres quantifiés sans GPU dédié. Ajoutez le silence total (pas de ventilateur audible en usage normal) et vous avez une machine qui tourne 24h/24 dans un coin du bureau sans que personne ne s'en rende compte.

Recommandation pratique : commencez sur votre machine principale. Si vous accrochez, investissez dans une machine dédiée. Et si votre conjoint(e) demande pourquoi il y a un Mac Mini de plus dans le salon, dites que c'est pour le télétravail. Techniquement, c'est pas faux.

Installation

Prérequis

- Node.js 22 ou supérieur

- Un terminal

- Un minimum de sang-froid (optionnel mais recommandé)

- Une clé API selon votre provider (Anthropic, OpenAI, Google…) ou un compte Claude Pro/Max pour l'auth OAuth

Installer Node.js si vous ne l'avez pas :

| Système | Méthode recommandée |

| macOS | brew install node (ou nodejs.org) |

| Windows | winget install OpenJS.NodeJS.LTS dans PowerShell |

| Linux (Ubuntu/Debian) | Voir commande dans la section Linux ci-dessous |

Le script d'installation d'OpenClaw détecte et installe Node automatiquement — mais autant le faire proprement en amont.

macOS

curl -fsSL https://openclaw.ai/install.sh | bash

Le script installe Node.js s'il manque, installe OpenClaw, puis lance automatiquement l'assistant de configuration (onboarding). L'onboarding vous propose d'installer le daemon launchd — acceptez pour qu'OpenClaw démarre automatiquement au boot.

Linux (Ubuntu/Debian)

Même one-liner :

curl -fsSL https://openclaw.ai/install.sh | bash

L'onboarding se lance automatiquement après l'installation. Le daemon systemd démarre au boot et redémarre en cas de crash.

Si vous préférez installer Node.js et OpenClaw manuellement :

npm install -g openclaw@latest

openclaw onboard --install-daemon

Note VPS — si votre machine a moins de 2 Go de RAM, ajoutez du swap avant de commencer :

sudo fallocate -l 2G /swapfile

sudo chmod 600 /swapfile

sudo mkswap /swapfile

sudo swapon /swapfile

echo '/swapfile none swap sw 0 0' | sudo tee -a /etc/fstab

Windows

La méthode recommandée passe par WSL2, qui offre un environnement Linux complet et une compatibilité maximale avec tous les outils et skills :

Dans PowerShell en admin : installer WSL2 avec Ubuntu

wsl --install -d Ubuntu

Redémarrez, puis dans le terminal Ubuntu :

curl -fsSL https://openclaw.ai/install.sh | bash

Une fois dans WSL2, vous êtes dans un environnement Linux à part entière. L'expérience est identique.

Un installeur PowerShell natif existe aussi :

iwr -useb https://openclaw.ai/install.ps1 | iex

Mais certains skills et outils Linux ne fonctionneront pas sans WSL2. À réserver aux cas où WSL2 n'est pas une option.

Docker existe comme alternative pour des usages conteneurisés ou des déploiements multi-instances, mais ce n'est pas la méthode recommandée pour un usage personnel. Le one-liner est plus simple, plus rapide à mettre à jour, et mieux supporté.

Configuration guidée : l'onboarding wizard

L'onboarding se lance automatiquement à la fin de l'installation. Si vous avez besoin de le relancer (changement de provider, ajout d'un channel…), la commande est « openclaw onboard ». Voici ce qu'il vous demande.

Gateway mode

Deux options : « local » ou « remote ».

Choisissez « local ». Le gateway tourne sur votre machine, sur le port 18789. Votre configuration, votre mémoire et vos fichiers restent chez vous. Les messages envoyés au modèle, eux, transitent par l'API du provider choisi (Anthropic, OpenAI, Google…) — sauf si vous utilisez un modèle 100 % local. Le mode remote existe pour connecter un client à un gateway distant (VPS, autre machine), mais pour un usage perso sur une seule machine c'est inutile.

Authentification et modèles : branchez ce que vous voulez

Un des points forts d'OpenClaw : il est totalement agnostique côté modèle. Vous n'êtes enfermé dans aucun écosystème. Anthropic, OpenAI, Google, Mistral, Meta, xAI, des modèles locaux via Ollama, un serveur LM Studio sur votre réseau, un provider exotique compatible OpenAI… tout se branche. Vous pouvez même mixer les providers — un modèle principal chez Anthropic, des sous-agents chez Google, et un fallback local via Ollama.

Le wizard vous propose les providers les plus courants :

- Anthropic (clé API sur console.anthropic.com, ou OAuth si vous avez un abonnement Claude Pro/Max)

- OpenAI (clé API sur platform.openai.com)

- Google (clé API sur aistudio.google.com — quota gratuit généreux)

- Ollama (aucune clé, 100 % local et gratuit)

- OpenRouter (une seule clé pour accéder à des dizaines de modèles)

- Custom Provider (tout endpoint compatible OpenAI ou Anthropic — LM Studio, vLLM, Together AI, Groq, Fireworks…)

Mais le choix du modèle n'est pas anodin. Et c'est là qu'on arrive au concept le plus important.

L'importance de la hiérarchie des modèles

OpenClaw n'utilise pas un seul modèle. Il en utilise plusieurs en parallèle, avec des rôles différents. Et la règle d'or, c'est celle-ci : votre modèle principal (l'orchestrateur) doit être le plus puissant que vous puissiez vous offrir.

Pourquoi ? Parce que c'est lui qui :

- Comprend votre demande et décide quoi en faire

- Choisit quels outils utiliser et dans quel ordre

- Délègue les sous-tâches aux bons « muscles »

- Synthétise les résultats et vous répond de façon cohérente

- Respecte vos règles (AGENTS.md) et votre contexte (USER.md, MEMORY.md)

Un modèle faible en orchestrateur, c'est comme un chef de projet junior à qui vous confiez 10 freelances seniors : il va se planter sur la coordination, oublier des consignes, et produire un résultat incohérent. Un modèle fort, même si les exécutants sont plus légers, va produire un résultat propre parce qu'il sait quoi demander et comment assembler les pièces.

Concrètement, voici comment ça se structure :

| Rôle | Ce qu'il fait | Exemples de modèles |

| Orchestrateur (principal) | Comprend, décide, délègue, synthétise | Claude Opus 4.6, GPT-5, Gemini 3.1 Pro |

| Exécutant code (sous-agent) | Écrit, debug, refactorise du code | Claude Sonnet 4.6, Codestral, DeepSeek Coder |

| Recherche web (outil natif) | Cherche et synthétise des sources récentes | Perplexity Sonar Pro |

| Tâches légères (sous-agent) | Résumés, formatage, tâches simples | Claude Haiku 4.5, Gemini 3 Flash, Llama 4 Scout |

| Fallback local (backup) | Prend le relais si l'API est down | Ollama (Qwen, Mistral, Llama) |

L'orchestrateur reçoit votre message, comprend l'intention, et spawne automatiquement des sous-agents sur des modèles plus légers (donc moins chers et plus rapides) pour les tâches spécifiques. Pendant que Sonnet écrit votre script Python, l'orchestrateur reste disponible pour votre prochaine question.

Recommandation pour débuter — configurez le modèle le plus puissant que votre budget autorise en principal. Si vous avez un abonnement Claude Max, mettez Opus 4.6. Sinon, Sonnet 4.6 fait un excellent orchestrateur. Les sous-agents et les configs budget détaillées sont dans la section « guide du power user ».

Vous pourrez changer de modèle à tout moment :

openclaw config set agents.defaults.model.primary "anthropic/claude-sonnet-4-6"

Choix du channel de messagerie

C'est ici que vous définissez comment vous parlerez à votre agent. Le wizard vous propose les channels les plus populaires : Telegram (le plus simple pour démarrer), WhatsApp (QR code et c'est fait), Discord (le plus puissant pour un usage avancé), Signal, Slack, iMessage, et bien d'autres (IRC, Matrix, Teams, Twitch, Line, Google Chat…).

On détaille les avantages et inconvénients de chacun dans la section « guide du power user » plus bas. Pour l'instant, si vous hésitez : Telegram pour commencer vite, Discord si vous voulez le setup le plus complet.

La plupart des channels se connectent de la même façon après l'installation :

openclaw channels login --channel <nom>

Sécurité et pairing

OpenClaw ne répond pas à n'importe qui. Le système de sécurité repose sur deux mécanismes.

L'allowlist et le pairing

Par défaut, OpenClaw fonctionne en mode « pairing » : seuls les identifiants explicitement autorisés (votre numéro WhatsApp, votre user ID Telegram ou Discord…) peuvent interagir avec l'agent. Si quelqu'un qui n'est pas dans votre allowlist envoie un message, le bot lui renvoie un code de pairing (8 caractères, majuscules) — mais ne traite pas son message. C'est à vous de valider :

Voir les demandes de pairing en attente (par channel)

openclaw pairing list telegram

openclaw pairing list discord

openclaw pairing approve telegram ABCD1234

openclaw pairing approve discord WXYZ5678

Les codes expirent après 1 heure. Maximum 3 demandes en attente par channel.

Résultat : même si quelqu'un connaît l'adresse de votre gateway, il ne peut rien faire sans être dans l'allowlist. Et vous gardez le contrôle total sur qui a accès. Votre chat n'aura donc pas accès à l'agent. Votre ex non plus.

Verrouiller votre agent

Le pairing contrôle qui peut parler à l'agent. Mais il faut aussi contrôler ce que l'agent peut faire. Par défaut, OpenClaw a un accès shell complet à votre machine : il peut exécuter n'importe quelle commande. C'est puissant, mais ça mérite d'être cadré.

L'audit de sécurité intégré

OpenClaw embarque un audit automatique qui vérifie votre configuration et signale les failles courantes : permissions de fichiers trop permissives, groupes ouverts, authentification manquante, browser exposé…

openclaw security audit

openclaw security audit --deep

openclaw security audit --fix

L'option « --fix » applique les corrections sans risque : resserrer les permissions de fichiers, passer les groupes ouverts en allowlist, activer la rédaction des données sensibles dans les logs. Elle ne touche pas à vos tokens, ne désactive pas d'outils, ne change pas votre réseau.

Lancez-le une fois après l'installation, puis après chaque changement de config. C'est l'équivalent d'un doctor pour la sécurité.

Les approbations d'exécution

Si vous voulez garder un humain dans la boucle, activez les exec approvals. L'agent vous demande la permission avant d'exécuter une commande sur votre machine — vous voyez la commande exacte, le répertoire, et vous validez ou refusez.

Trois modes : « deny » (tout bloquer), « allowlist » (n'autoriser que les commandes validées), « full » (tout autoriser — le défaut). Le mode recommandé pour démarrer : « allowlist » avec « ask: "on-miss" » — l'agent vous demande pour chaque nouvelle commande, et vous pouvez dire « toujours autoriser » pour celles que vous connaissez.

Le sandboxing par provider

Pour les modèles moins fiables (petits modèles locaux, providers expérimentaux), vous pouvez restreindre les outils accessibles. Exemple : votre Qwen local n'a pas besoin d'accéder au gateway, au browser ni aux crons. Bloquez-les et il ne pourra faire que du texte.

Les règles d'or

- Le port 18789 du gateway ne doit jamais être exposé sur Internet sans authentification. Si vous êtes sur un VPS, gardez-le derrière un VPN ou un tunnel SSH.

- Commencez restrictif, élargissez progressivement. Il est toujours plus facile d'ouvrir que de refermer.

- Backupez ~/.openclaw/openclaw.json avant toute modification de sécurité.

Et comme pour tout le reste : vous n'avez pas besoin de configurer ça à la main. « Lance un audit de sécurité et applique les corrections recommandées » suffit.

Vérification : est-ce que ça tourne ?

Une fois l'installation terminée, trois commandes à connaître :

Statut du daemon

openclaw gateway status

openclaw doctor

openclaw logs --follow

Vous pouvez aussi ouvrir le dashboard web :

openclaw dashboardOu directement dans le navigateur : http://127.0.0.1:18789/

Le dashboard affiche les sessions actives, les canaux connectés, la consommation de tokens, les crons planifiés. Pratique pour avoir une vue d'ensemble. C'est aussi l'endroit où vous réaliserez que votre agent a été plus productif que vous cette semaine.

Comment bien le configurer : le guide du power user

L'installation de base, c'est bien. Mais OpenClaw devient vraiment puissant quand vous le configurez avec intention. Avant d'entrer dans le détail, un point essentiel : tout ce qui suit — la hiérarchie des modèles, les crons, la mémoire, les channels — se configure en parlant à votre agent. Pas en éditant des fichiers JSON à la main, pas en cherchant la bonne syntaxe dans la doc. Vous décrivez ce que vous voulez en français, l'agent s'en charge. Les sections qui suivent vous expliquent les concepts pour que vous sachiez quoi demander. La mise en place, c'est lui qui la fait.

Concrètement, ça donne quoi ?

Voici le genre de messages que j'envoie à mon agent sur Discord — et ce qu'il fait derrière :

« Configure un fallback sur LM Studio avec Qwen si Anthropic tombe »

→ L'agent édite la config du gateway, ajoute le provider LM Studio, télécharge le modèle, définit la chaîne de fallback, redémarre le daemon.

« Mets en place une veille tech tous les matins à 9h, envoie le résultat sur #veille-tech »

→ Il crée le cron job, écrit le script de collecte RSS, configure le scoring, teste une première exécution, et vous envoie le premier briefing pour validation.

« Mon agent vocal ne marche plus depuis la mise à jour »

→ Il lit les logs, identifie l'erreur, cherche dans la doc officielle si c'est un bug connu, applique le correctif, et vérifie que ça remarche.

« Ajoute dans ma config que je veux des réponses courtes et directes, jamais de blabla »

→ Il met à jour SOUL.md avec vos préférences de ton. Dès la session suivante, les réponses changent.

« Je veux un channel Discord dédié par projet, avec des notifications différentes pour chacun »

→ Il vous guide pas à pas pour créer le serveur, propose une structure de channels, et configure les contextes isolés.

Vous n'avez pas besoin de connaître les commandes CLI, la syntaxe des crons, ou le format des fichiers de mémoire. Vous décrivez le résultat souhaité, l'agent trouve le chemin.

L'architecture cerveau/muscles en pratique

On a expliqué le principe plus haut dans le choix des modèles. Voyons maintenant comment ça se passe au quotidien.

Quand vous demandez « cherche les dernières news sur l'IA et code-moi un script de veille », voici ce qui se passe en coulisses :

- L'orchestrateur (votre modèle principal) reçoit la demande

- Il lance une recherche Perplexity en parallèle (outil natif, pas de sous-agent)

- Il spawne un sous-agent Sonnet pour écrire le script Python

- Pendant que les deux travaillent, il reste disponible si vous envoyez un autre message

- Il récupère les résultats, les synthétise, et vous répond de façon cohérente

Tout ça prend 10-30 secondes selon la complexité. Vous ne gérez rien — l'orchestrateur décide seul quand déléguer et à qui.

La beauté du système, c'est que ça marche avec n'importe quelle combinaison de providers. Orchestrateur chez Anthropic, sous-agents chez Google, recherche web via Perplexity, fallback local via Ollama — OpenClaw s'en fiche, il route les appels au bon endroit.

Quelques configs réalistes selon le budget

- Budget illimité (Claude Max) — Opus 4.6 en orchestrateur, Sonnet 4.6 pour le code, Haiku 4.5 pour les tâches simples, Sonar Pro de Perplexity pour la recherche.

- Budget modéré (API payante) — Sonnet 4.6 en orchestrateur, Gemini 3 Flash pour les tâches légères, Perplexity pour la recherche.

- Budget zéro — Gemini 3 Flash en orchestrateur (quota gratuit Google), Ollama + Llama 4 Scout pour le code, Perplexity gratuit pour la recherche.

- Tout local (air-gapped) — Ollama avec Qwen 3.5 35B ou Llama 4 Maverick en orchestrateur, modèles plus petits pour les sous-tâches. Aucune donnée ne quitte votre machine.

Et pour ceux qui veulent le meilleur des deux mondes : les modèles locaux font d'excellents fallbacks. Sur notre setup, le cerveau principal tourne sur Claude Opus 4.6 via API. Mais si Anthropic tombe (ça arrive), OpenClaw bascule automatiquement sur un Qwen 3.5 35B quantifié en Q8, hébergé en local via LM Studio sur le même Mac Mini. C'est plus lent (10-20 secondes sur du gros contexte), un peu moins fin dans le raisonnement, mais ça répond. L'agent ne s'arrête jamais. Vous pouvez faire la même chose avec Ollama et n'importe quel modèle de la bibliothèque — Llama, Mistral, Gemma, Phi… L'idée, c'est que votre assistant ne dépende jamais à 100 % d'une API distante. Pas besoin de configurer tout ça à la main, décrivez votre budget et vos priorités à l'agent, il mettra en place la bonne hiérarchie.

Le système mémoire : la killer feature

C'est probablement la fonctionnalité la plus sous-estimée d'OpenClaw.

L'agent se réveille « frais » à chaque nouvelle session — il ne se souvient pas de ce que vous avez dit hier. Mais le workspace, lui, persiste. Et OpenClaw injecte automatiquement les fichiers de votre workspace au début de chaque session.

Les fichiers qui constituent la mémoire de votre agent :

- SOUL.md — la personnalité de votre agent : son ton, ses limites, sa façon de répondre. « Sois direct, pas de blabla marketing, humour sec bienvenu. »

- USER.md — qui vous êtes : vos préférences, vos projets en cours, votre contexte professionnel. Plus c'est détaillé, plus l'agent est pertinent. « Je bosse chez Clubic, je suis développeur le week-end, ma fille s'appelle Léa. »

- AGENTS.md — le règlement intérieur : les hard rules, les workflows, les conventions. « Ne jamais envoyer un email sans validation explicite. Toujours vérifier git status avant de commit. »

- IDENTITY.md — le nom et la vibe de l'agent : « Tu t'appelles Akira. Ton emoji est ⚡. »

- TOOLS.md — des notes sur vos outils locaux : chemins de scripts, credentials, commandes spécifiques à votre setup.

- MEMORY.md — la mémoire long terme curatée, comme un journal intime de l'IA. L'agent peut la lire et la mettre à jour. Elle contient ce qui vaut la peine d'être retenu entre les sessions.

- memory/YYYY-MM-DD.md — les notes quotidiennes brutes, générées et mises à jour au fil des sessions.

- HEARTBEAT.md — une checklist pour les vérifications périodiques (on y revient).

Le principe : vous enrichissez ces fichiers progressivement. Au bout de quelques semaines, votre agent vous connaît vraiment — vos projets, vos préférences, vos habitudes. Et comme ce sont des fichiers Markdown, vous pouvez les éditer directement, sans interface spéciale.

💡Conseils pratiques pour bien démarrer

Commencez par les fichiers qui comptent. USER.md et SOUL.md sont les deux fichiers qui transforment un agent générique en votre agent. Le reste viendra naturellement au fil de l'usage. Vous pouvez les éditer à la main, mais « ajoute dans ma mémoire que je déteste les résumés trop longs » fonctionne aussi.

Posez des hard rules dès le premier jour. Votre agent a accès à tout — shell, fichiers, emails, git. Sans garde-fous, c'est un stagiaire avec les clés du coffre-fort. Dans AGENTS.md, posez les limites :

- Toujours utiliser « config.patch » avec un « baseHash » (verrou optimiste — si la config a changé entre-temps, le patch est rejeté au lieu d'écraser).

- Jamais de « clone », « revert » ou « reset --hard » sans « git status » d'abord

- Jamais envoyer un e-mail, un post ou un paiement sans accord explicite

- Préférer la corbeille à « rm » — pas de suppression irréversible sans demander

- Conflits git : demander à l'humain, ne jamais résoudre seul

Vous n'avez pas besoin de ces règles exactes. Mais vous avez besoin de règles. « Ajoute ces hard rules dans AGENTS.md » suffit.

Boostez la mémoire. Le moteur par défaut fonctionne, mais il est basique. Demandez à votre agent d'installer QMD — un moteur de recherche local qui combine mots-clés (BM25), vecteurs sémantiques et reranking. Tout tourne en local. Ajoutez-y l'indexation des sessions : l'agent pourra retrouver ce que vous avez dit il y a trois semaines, même s'il ne l'a jamais écrit dans un fichier. Un seul message : « installe QMD pour la mémoire, active l'indexation des sessions, passe les prompts de compaction en français, et active le hybrid search avec MMR et temporal decay. »

Pourquoi Discord est le setup idéal

Telegram est plus simple à configurer. WhatsApp est déjà sur votre téléphone. Mais Discord est objectivement le meilleur setup pour un usage sérieux.

L'idée : créer un serveur Discord privé avec des channels dédiés par sujet ou projet.

Serveur "Akira"

├── 🧠 Général

│ ├── #daily → interactions quotidiennes

│ └── #chat → conversation libre

├── 📰 Veille

│ ├── #veille-tech → briefings automatiques

│ └── #veille-ia → news IA

├── 🗒️ Projets

│ ├── #dayone → mon app de suivi de jeux vidéo

│ └── #clubic-sr → mon extension de correction IA

├── 💻 Dev

│ ├── #coding → tâches de développement

│ └── #logs → monitoring, erreurs

└── ⚙️ Config

└── #memory → mises à jour de contexte

L'avantage technique : chaque channel Discord est une session isolée avec son propre contexte. Quand vous êtes dans #coding, l'agent sait qu'il est en mode dev. Dans #daily, il est en mode assistant généraliste. Pas de pollution de contexte.

Les autres avantages Discord :

- Slash commands natifs

- Réactions emoji pour les confirmations rapides

- Threads pour isoler des sous-conversations

- Historique persistant consultable

- Notifications push sur mobile (iOS et Android)

- Totalement gratuit et personnalisable

- Bots supplémentaires si besoin

Comparatif rapide des autres channels

| Channel | Facilité | Fiabilité | Organisation | Idéal pour |

| Telegram | ★★★★★ | ★★★★★ | ★★★☆☆ | Démarrer vite |

| ★★★★★ | ★★★☆☆ | ★★☆☆☆ | Usage mobile ponctuel | |

| Discord | ★★★★☆ | ★★★★★ | ★★★★★ | Usage avancé, multi-projets |

| Signal | ★★☆☆☆ | ★★★★☆ | ★★☆☆☆ | Confidentialité maximale |

| Slack | ★★★★☆ | ★★★★★ | ★★★★☆ | Contexte pro/équipe |

| iMessage | ★★★★☆ | ★★★★☆ | ★★☆☆☆ | Utilisateurs Apple uniquement |

- Telegram — bot API officiel, zéro friction, idéal pour commencer. Limite : pas de channels structurés, tout dans un seul DM.

- WhatsApp — pratique car déjà sur le téléphone. Le pairing par QR code prend 30 secondes. Mais le protocole (Baileys) n'est pas officiel — Meta peut théoriquement bannir des comptes en cas d'usage suspect. Pas recommandé pour du 24/7.

- Signal — le plus sécurisé (chiffrement E2EE natif, aucune métadonnée chez un tiers). Mais signal-cli est complexe à configurer et génère des edge cases. Réservé aux cas où la confidentialité est une contrainte dure.

- Slack — parfait si vous voulez intégrer l'agent dans un contexte d'équipe. Partage de contexte entre collègues, workflows de validation, etc.

- iMessage — natif Apple, aucune installation de bot externe. Nécessite un Mac allumé avec Messages ouvert. Pratique pour les utilisateurs Apple qui veulent rester dans l'écosystème.

Les crons et heartbeats

Deux mécanismes pour automatiser sans intervenir.

Les crons — des tâches planifiées précises, gérées par le scheduler intégré au gateway. Ils persistent sur disque (~/.openclaw/cron/) et survivent aux redémarrages.

Rappel ponctuel dans 20 minutes (parce que vous allez oublier, on le sait)

openclaw cron add \

--name "Rappel plombier" \

--at "20m" \

--session main \

--system-event "Rappel : appeler le plombier" \

--wake now \

--delete-after-run

openclaw cron add \

--name "Veille tech" \

--cron "0 9 * * *" \

--tz "Europe/Paris" \

--session isolated \

--message "Lance la veille tech et envoie le résultat." \

--announce \

--channel discord

openclaw cron list

openclaw cron runs --id <job-id>

Cas d'usage typiques :

- Veille tech/IA à heure fixe

- Rappels ponctuels (avec --at et --delete-after-run)

- Monitoring de builds CI/CD

- Backup automatique de votre workspace

Les heartbeats — des vérifications périodiques en mode « battement de cœur ». Par défaut toutes les 30 minutes, l'agent vérifie votre HEARTBEAT.md et agit si quelque chose requiert son attention.

HEARTBEAT.md est une checklist simple :

- Vérifier emails urgents non lus

- Rappeler les événements calendrier dans les 2h

- Signaler si un build CI est cassé depuis > 30 min

- Si rien à signaler : silence

La règle d'or : regroupez les vérifications dans HEARTBEAT.md plutôt que de multiplier les crons. Un heartbeat qui check cinq choses toutes les 30 minutes coûte moins cher en tokens qu'un cron séparé pour chacune.

Un mot sur la consommation : chaque heartbeat, chaque cron, chaque sous-agent consomme des tokens. Un heartbeat toutes les 30 minutes avec un modèle premium, ça représente une centaine de requêtes par jour — et ça chiffre. Commencez avec peu d'automatisations, surveillez votre consommation via le dashboard (openclaw dashboard), et montez progressivement. Les modèles légers (Haiku, Gemini Flash) sont vos alliés pour les tâches récurrentes. Toutes ces commandes sont là pour référence. En pratique, « rappelle-moi d'appeler le plombier dans 20 minutes » suffit.

Les messages vocaux : parler au lieu de taper

OpenClaw comprend nativement les messages vocaux. Sur Discord comme sur Telegram, envoyez un vocal : l'agent le transcrit automatiquement et traite votre demande comme n'importe quel message texte. Même accès aux outils, même mémoire, même contexte.

Dans l'autre sens, vous pouvez configurer l'agent pour qu'il réponde en vocal. Par défaut, le text-to-speech est désactivé. Pour l'activer avec Edge TTS (gratuit, aucune clé API) :

openclaw config set messages.tts.auto '"always"' --json

openclaw config set messages.tts.provider '"edge"' --json

openclaw config set messages.tts.edge.voice '"fr-FR-VivienneMultilingualNeural"' --json

Le mode « always » répond systématiquement en vocal. Si vous préférez que l'agent ne réponde en vocal que quand vous lui envoyez un vocal, utilisez « inbound » à la place de « always ».

Sur Discord, le résultat est un vrai message vocal natif (avec la forme d'onde). Sur Telegram, c'est la bulle ronde habituelle. Ce n'est pas de la conversation en temps réel — c'est du push-to-talk asynchrone : vous envoyez, l'agent répond quelques secondes plus tard. Moins spectaculaire qu'un agent vocal dédié, mais infiniment plus pratique au quotidien. Vous pouvez taper les commandes config set ci-dessus, ou simplement demander « active les réponses vocales en français ». Même résultat.

Définir qui tu es — et qui est ton agent

C'est la partie que la plupart des gens négligent, et c'est pourtant ce qui fait la différence entre un agent générique et un agent qui vous ressemble.

Remplissez USER.md sérieusement : vos préférences de communication, vos projets en cours, votre contexte pro, vos contraintes, vos outils habituels. Plus c'est détaillé, plus les réponses sont pertinentes. L'agent qui sait que vous êtes journaliste tech va calibrer ses réponses différemment de celui qui vous croit développeur backend.

Donnez une identité à votre agent via SOUL.md : définissez son ton, ses limites, ses valeurs. « Pas de blabla, pas de marketing. Dis-moi directement si tu ne sais pas. Humour sec autorisé. » Ce fichier est ce qui transforme un LLM générique en quelqu'un qui vous ressemble.

IDENTITY.md pour le nom et l'emoji : ça paraît anecdotique mais ça change vraiment la relation. Un agent qui a un nom répond différemment d'un « assistant IA ». Le mien s'appelle Akira. Non, je ne lui parle pas avant de dormir. Enfin, pas tous les soirs.

AGENTS.md comme règlement intérieur : les hard rules que l'agent ne peut pas violer (ne jamais envoyer un email sans confirmation explicite), les conventions de nommage de fichiers, les workflows récurrents. C'est votre « manuel d'opérations » que l'agent relit à chaque session.

Le « brain dump » : pourquoi il faut tout lui dire (ou presque)

C'est contre-intuitif, mais c'est le conseil le plus important de ce guide : videz-vous la tête dans USER.md.

Un agent IA, c'est comme un assistant brillant qui débarque le premier jour sans rien connaître de vous. Si vous lui dites juste votre prénom et votre métier, il va vous donner des réponses génériques — correctes, mais fades. Si vous lui expliquez que vous bossez dans le journalisme tech, que vous jonglez entre trois projets perso, que vous avez une fille de 4 ans qui vous laisse bosser entre 21h et minuit, que vous détestez le remplissage marketing, et que vous voulez des réponses en français avec de la typographie propre — là, il devient utile. Vraiment utile.

Concrètement, voici ce qui mérite d'aller dans USER.md :

- Votre contexte pro : poste, entreprise, responsabilités, outils utilisés au quotidien

- Vos projets en cours : nom, état d'avancement, stack technique, objectifs

- Vos préférences de communication : langue, ton, niveau de détail attendu, formatage

- Vos contraintes : horaires, budget, compétences techniques (ou manque de), deadlines

- Vos centres d'intérêt : ce que vous suivez, ce qui vous fait réagir, vos sources d'info préférées

- Vos objectifs : court terme, long terme, financiers, professionnels — tout ce qui aide l'agent à prioriser

Oui, ça ressemble à un profil de rencontre pour robot.

Plus le contexte est riche, plus l'agent calibre ses réponses. Un USER.md de 50 lignes bien remplies vaut mieux que 500 conversations où l'agent doit deviner qui vous êtes.

💡L'astuce : le reverse prompting

L'astuce si vous ne savez pas par où commencer : le reverse prompting. La technique vient d'Alex Finn et elle est redoutablement efficace. Au lieu de fixer un fichier vide, procédez en deux étapes :

Étape 1 — Le brain dump brut. Ouvrez un chat avec votre agent et videz-vous la tête : qui vous êtes, ce que vous faites, vos projets, vos ambitions, vos frustrations. Pas besoin de structurer, écrivez comme ça vient. Puis envoyez ce reverse prompt :

« D'après ce que tu sais de moi et de mes objectifs, quelles informations supplémentaires est-ce que je peux te donner pour que tu puisses m'aider à atteindre mes objectifs plus vite et me décharger au maximum ? »

L'agent va vous poser des questions ciblées auxquelles vous n'auriez pas pensé — votre budget, vos horaires, vos compétences techniques, vos outils actuels, vos blocages récurrents.

Étape 2 — La mise en action. Une fois que vous avez répondu à ses questions, enchaînez avec :

« Qu'est-ce que tu peux faire pour moi maintenant pour qu'on avance vers nos objectifs ? »

Vous allez découvrir des dizaines d'usages auxquels vous n'aviez pas pensé. Demandez-lui ensuite de synthétiser tout ça en USER.md structuré. Résultat : un fichier complet, pertinent, et un agent qui sait exactement quoi faire pour vous.

Et ça ne s'arrête pas à USER.md. Chaque interaction enrichit la mémoire de l'agent — les notes quotidiennes dans memory/, les leçons apprises dans MEMORY.md, les règles affinées dans AGENTS.md. Au bout de quelques semaines, vous avez un assistant qui vous connaît mieux que n'importe quel outil que vous avez jamais utilisé.

Ce qu'il ne faut PAS lui dire

Parce que oui, il y a une limite.

Les fichiers de mémoire d'OpenClaw sont stockés en clair sur votre machine — c'est du Markdown, pas un coffre-fort. Et chaque message que vous envoyez à l'agent transite par l'API du provider (Anthropic, OpenAI, Google…) pour être traité par le modèle. Même si ces providers ont des politiques strictes de non-rétention des données API, la règle de base reste : ne mettez dans le workspace que ce que vous accepteriez de voir fuiter.

Ce qui n'a rien à faire dans vos fichiers de mémoire :

- Numéros de carte bancaire, codes PIN, mots de passe en clair : ça paraît évident, mais quand on commence à tout dumper dans USER.md à 23h, la frontière devient floue

- Numéros de sécurité sociale, pièces d'identité : aucune raison que l'agent en ait besoin

- Secrets d'entreprise classifiés : NDA, documents confidentiels, stratégies non publiques de votre employeur

- Données médicales sensibles : diagnostics, traitements, résultats d'examens

- Informations bancaires détaillées : RIB, IBAN, relevés

En revanche, les clés API et tokens techniques (pour que l'agent accède à vos services) vont dans ~/.openclaw/.env — un fichier séparé du workspace, non injecté dans le contexte du modèle, et que vous ne commitez jamais dans un repo.

La règle : contexte personnel = oui, données sensibles = non. Dire à l'agent que vous gagnez 3 000 € net et que vous visez 5 000 € d'ici fin 2026, c'est du contexte utile pour qu'il calibre ses suggestions business. Lui donner votre numéro de CB pour qu'il « gère vos achats », c'est de l'inconscience.

Dernier point : si vous backupez votre workspace dans un repo Git (ce que je recommande), assurez-vous qu'il soit privé. Un USER.md bien rempli, c'est un profil complet de votre vie professionnelle et personnelle. Pas exactement ce que vous voulez rendre public sur GitHub.

Quand ça casse (et ça va casser)

Soyons honnêtes : OpenClaw est un outil aussi puissant que jeune. Le projet évolue vite, très vite — parfois trop. Une mise à jour peut casser un channel, un modèle peut halluciner une commande dangereuse, un cron mal configuré peut vous spammer 200 messages à 3h du matin. Ça m'est arrivé. Plus d'une fois. Ma compagne a moyennement apprécié.

Ne vous lancez pas tête baissée. Voici les conseils que j'aurais aimé avoir dès le premier jour :

Travaillez avec un plan, pas à l'instinct

Avant de demander à votre agent de « refactorer tout le projet » ou de « configurer le monitoring complet », prenez 5 minutes pour écrire ce que vous voulez obtenir. Demandez-lui de proposer un plan d'action avant d'exécuter quoi que ce soit. Un agent avec un plan produit du travail propre. Un agent sans plan produit du chaos.

Concrètement : « Propose-moi un plan pour mettre en place la veille tech, étape par étape, sans rien exécuter pour l'instant. » C'est toujours plus sûr que « Lance la veille tech. »

Demandez-lui d'aller lire la doc

OpenClaw embarque sa propre documentation en local (/docs/). L'agent peut la lire. Si vous bloquez sur une config, ne devinez pas : demandez-lui « va lire la doc officielle sur les crons » ou « cherche sur le Discord communautaire si d'autres ont eu ce problème ». Il a accès au web, aux docs, aux forums — autant qu'il s'en serve au lieu d'inventer une réponse.

Le Discord communautaire (discord.com/invite/clawd) est une mine d'or. Les retours d'utilisateurs y sont souvent plus à jour que la doc officielle.

⛑️Les commandes de secours

Quand plus rien ne répond, voici votre kit de survie dans le terminal :

L'agent ne répond plus ? Redémarrez le daemon

openclaw gateway restart

openclaw doctor

openclaw logs --follow

openclaw channels status

openclaw channels login --channel discord

openclaw cron list

openclaw cron remove <job-id>

openclaw gateway stop

Les erreurs classiques du débutant

- Donner trop d'autonomie trop tôt : commencez en mode « propose, n'exécute pas ». Augmentez les permissions progressivement.

- Parler à son agent comme à Siri « Mets un minuteur de 5 minutes. » Non. Votre agent peut coder une application mobile complexe pendant que vous dormez. Demandez-lui des trucs à la hauteur.

- Négliger les fichiers de mémoire : un USER.md vide = un agent générique. Prenez 10 minutes pour le remplir, ça change tout.

- Oublier de sauvegarder sa config : faites un backup de ~/.openclaw/openclaw.json avant toute modification. Un config set maladroit peut casser votre setup.

- Lancer des tâches lourdes sans les tester : un cron qui plante en boucle consomme des tokens pour rien. Testez manuellement d'abord, automatisez ensuite.

L'ultime conseil qui se mérite

Vous avez lu ce guide jusqu'ici ? Merci pour les impressions pub. Mais le meilleur conseil que je puisse vous donner : dès que votre agent sort de l'œuf, envoyez-lui l'URL de cet article et demandez-lui de tout mettre en place après vous avoir interviewé. Il adaptera chaque conseil à votre setup, vos besoins, votre budget. En 20 minutes, il aura fait ce que vous mettriez 3 heures à configurer manuellement.

Conclusion

OpenClaw n'est pas parfait. L'installation demande un peu de temps, le système de fichiers de mémoire a une courbe d'apprentissage, et certains channels (Signal, iMessage) peuvent donner des sueurs froides au setup.

Mais c'est l'outil le plus proche de « un assistant IA qui tourne vraiment chez vous, avec vos outils ». Pas un chatbot qui oublie tout à chaque session. Vos fichiers, votre mémoire, votre config restent sur votre machine. Vous gardez le contrôle.

Le modèle est simple : votre machine, votre agent, vos règles. Vous choisissez le LLM, le channel, le niveau d'autonomie. Et une fois configuré correctement — avec des fichiers de mémoire bien remplis, une architecture cerveau/muscles, des crons intelligents — c'est proprement bluffant.

Ça fait 12 ans que je travaille chez Clubic. 12 ans de « révolutions » oubliées six mois plus tard. J'étais devenu le gars qui lève les yeux au ciel à chaque keynote. Et puis un soir, à une heure du matin, j'ai vu mon agent résoudre un problème que je n'avais pas encore formulé. Il avait anticipé. Il bossait pendant que je dormais. Et le lendemain matin, le travail était là, propre, documenté, committé. J'ai eu un vertige. Le genre que je n'ai plus ressenti depuis la première fois que j'ai utilisé un iPhone ou la Wi-Fi.

Ce n'est pas une révolution de plus. C'est le moment où l'ordinateur arrête d'être un outil passif et commence à travailler avec vous.

Dans un prochain épisode, on poussera l'expérience encore plus loin : NVIDIA nous prête un DGX Spark pour faire tourner de gros modèles en local et réduire notre dépendance au cloud. Le but ultime : un agent aussi puissant qu'Opus, mais qui ne quitte jamais votre bureau. Stay tuned.