Pas de datacenter géant. Pas de milliards levés. Juste des maths quantiques et un résultat difficile à ignorer.

Une startup espagnole prend un modèle appartenant à OpenAI, le compresse de moitié et le met en libre accès. Multiverse Computing vient de publier HyperNova 60B 2602 sur Hugging Face. Pour comprendre la portée du geste, il faut d'abord regarder du côté de Mistral AI. La licorne française, dont les pratiques d'entraînement sont aujourd'hui sérieusement contestées semble laisser à d'autres le terrain qu'elle avait défriché.

HyperNova 60B : la moitié du poids pour presque tout le reste

La technologie derrière cette réduction s'appelle CompactifAI. Elle applique des mathématiques d'inspiration quantique pour analyser et restructurer les réseaux de neurones. Multiverse s'appuie ici sur son ADN originel : la société a démarré dans l'informatique quantique avant d'en transposer les méthodes à la compression de modèles d'IA. Selon la startup, CompactifAI préserve les composants les plus riches en information du réseau. Elle maintient une précision à 2 ou 3% près, contre 20 à 30% de perte avec les méthodes classiques.

Trente-deux gigaoctets, c'est un chiffre qui parle aux utilisateurs avancés. Ce poids place HyperNova 60B dans la fenêtre de la RTX 5090, dotée de 32 Go de VRAM. Un MacBook M3 ou M4 Pro configuré à 36 Go de RAM minimum peut également le faire tourner. Ce n'est pas anodin. Faire tourner ce type de modèle sur du matériel grand public ouvre la voie à un usage en local, sans envoi de données vers un serveur distant. Pour une organisation soucieuse de confidentialité, c'est un argument direct : les données restent sur l'appareil.

Cette version 2602 améliore aussi la prise en charge des appels d'outils et du codage agentique. Sur le benchmark BFCL v4, spécialisé dans les appels de fonctions, le gain atteint 1,5 fois la version précédente. Sur les tâches agentiques du Tau2-Bench, la progression est multipliée par cinq. La startup prévoit de publier d'autres modèles compressés en open source au cours de 2026.

Sur le plan financier, Multiverse Computing frôle le statut de licorne. Fondée en 2019 à Donostia, la société serait en discussion pour une levée de 500 millions d'euros. La valorisation visée serait supérieure à 1,5 milliard d'euros. L'entreprise a confirmé des discussions actives avec des investisseurs, sans valider les chiffres. Son chiffre d'affaires récurrent annuel aurait atteint 100 millions d'euros en janvier 2026, selon des sources que la startup n'a pas confirmées. Parmi ses clients officiellement déclarés : Iberdrola, Bosch et la Banque du Canada.

Quand le Pays Basque reprend le flambeau de l'IA sobre

Mistral AI avait bâti toute son identité sur l'efficience. La Mixture of Experts, la distillation, les modèles spécialisés : autant d'approches pensées pour faire plus avec moins. Mais Mistral semble avoir délaissé ce positionnement en 2026. Sur le terrain de l'efficience ouverte, DeepSeek et d'autres acteurs chinois ont pris le relais. Et l'enquête de Mediapart, parue cette semaine, a encore fragilisé l'image du champion français.

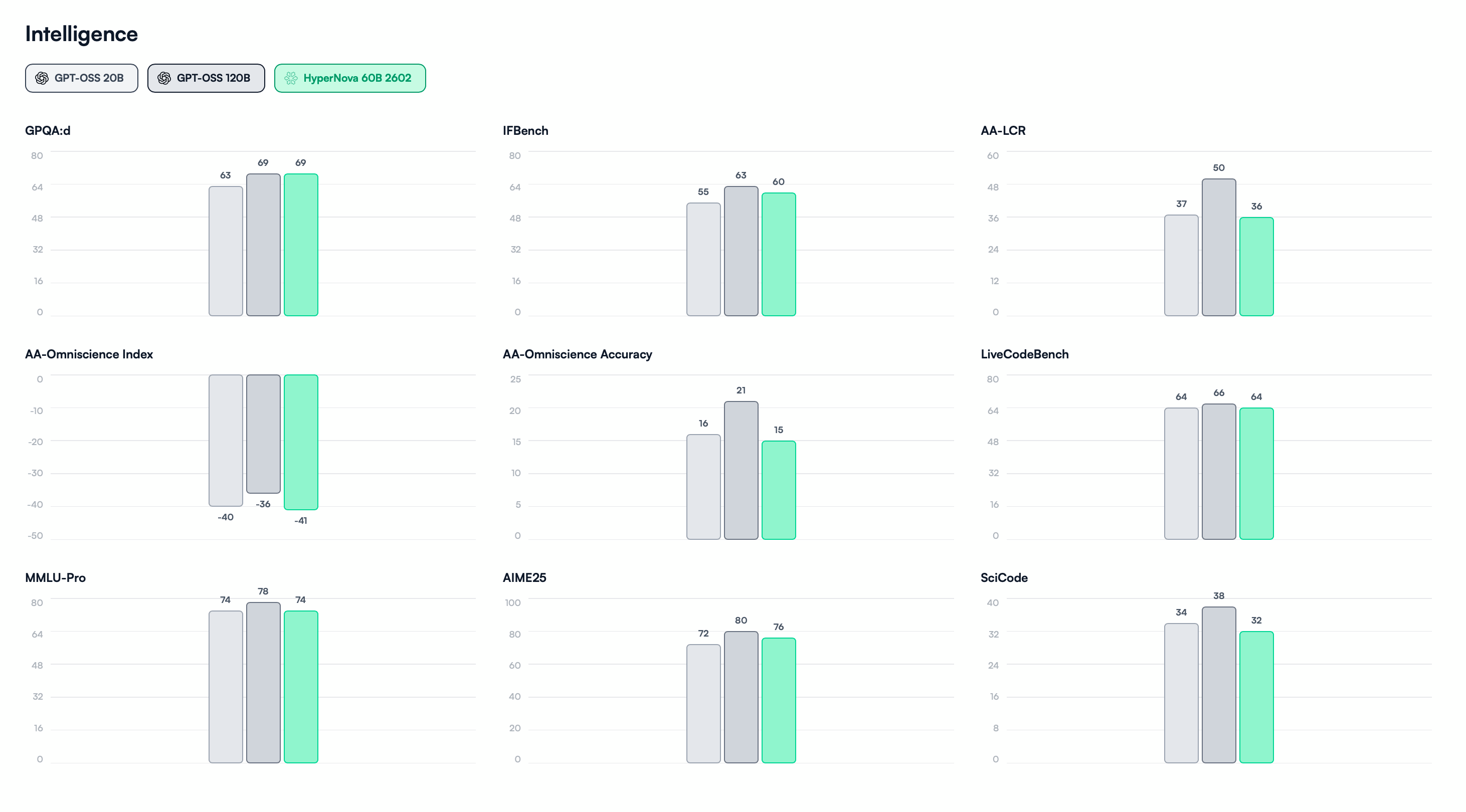

Multiverse s'engouffre dans ce vide avec la logique du Mistral des premières heures. L'objectif n'est pas de rivaliser avec GPT-5 ou Gemini 3 Pro sur les performances brutes. C'est de proposer un modèle capable, déployable sans infrastructure cloud, pour une fraction du coût en tokens. Les benchmarks publiés situent HyperNova 60B à parité avec le gpt-oss-120b d'OpenAI, ce qui le place dans un territoire de performance proche d'o4-mini. Mais pour une fraction du coût en tokens, et avec la possibilité de tout faire tourner en local.

La startup se positionne aussi sur le terrain de la souveraineté numérique. Multiverse a sécurisé un partenariat avec le gouvernement régional d'Aragon et bénéficie depuis ses débuts du soutien institutionnel basque. Dans un contexte où les États cherchent des alternatives aux fournisseurs américains, c'est un argument commercial qui pèse.

L'open source ajoute une dimension supplémentaire. Les modèles populaires sont presque toujours repris, affinés et optimisés par la communauté. Ministral 3.2 et DeepSeek R1 en sont deux exemples récents : leurs versions dérivées ont souvent dépassé les originaux sur des cas d'usage précis. HyperNova 60B a donc une trajectoire qui dépasse ses résultats de lancement.

Un bémol s'impose. Les benchmarks publiés sont ceux de Multiverse elle-même. La startup affirme avoir surpassé Mistral Large 3 sur plusieurs métriques, dont la latence et la consommation mémoire. Ces résultats mériteraient une confirmation par des tiers comme Arena.AIavant d'en faire une référence établie. Mais cela ne saurait tarder !