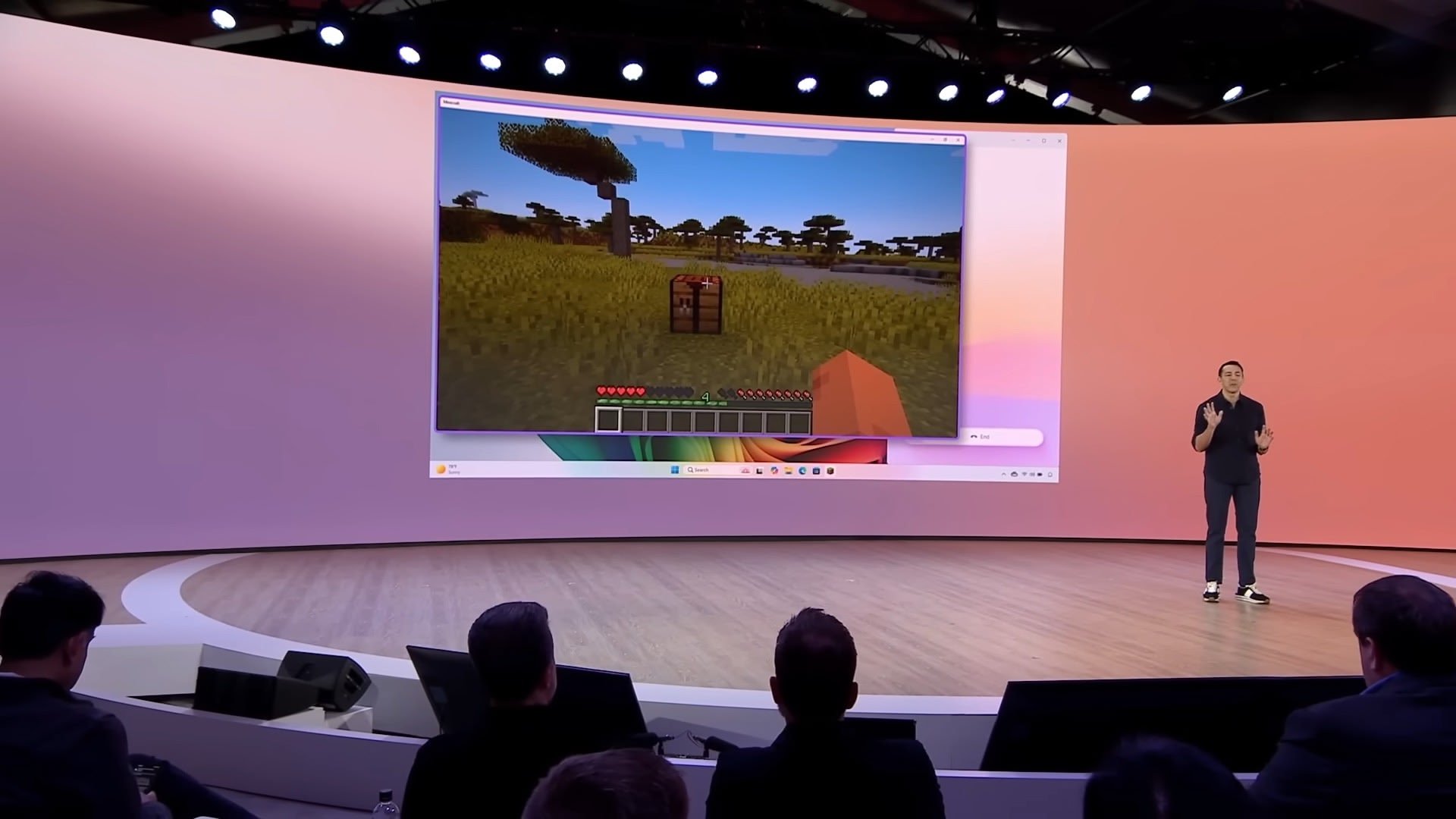

Microsoft déploie son assistant Gaming Copilot, un compagnon de jeu dopé à l’intelligence artificielle. Mais ce coach personnel a les yeux partout et n’hésite pas à envoyer vos sessions de jeu sur les serveurs de l'entreprise pour parfaire son éducation.

La belle promesse d'une intelligence artificielle au service des joueurs prend une tournure... intéressante. Avec Gaming Copilot, Microsoft nous offre un assistant capable de nous guider en pleine partie. Le souci ? Mine de rien, cet assistant analyse en permanence nos écrans et envoie les informations collectées à la maison mère pour entraîner ses modèles. Une pratique qui rappelle furieusement la polémique autour de la fonction Recall, et qui confirme que chez Microsoft, la curiosité n'est décidément pas un vilain défaut.

Un coach personnel un peu trop indiscret

Présenté comme un coéquipier virtuel, Gaming Copilot est en réalité un observateur zélé. Dès que vous ouvrez la barre de jeu de Windows 11, il se met au travail, même si vous ne lui demandez rien. Il capture votre écran, passe le tout à la moulinette de sa reconnaissance optique de caractères (la fameuse OCR), puis expédie le texte extrait directement chez Microsoft. Dialogues de personnages, scores, ou même une conversation privée sur une fenêtre adjacente : tout est bon à prendre.

- Intégration de DALL-E 3 pour une création d'images plus créatives et réalistes

- Capacité de traitement des images par GPT-4 Vision pour des réponses contextuelles précises

- Interface conviviale et intégrée dans divers produits Microsoft

C’est un joueur qui a découvert le pot aux roses en surveillant son trafic réseau. Il testait un jeu sous accord de confidentialité, mais cela n'a pas empêché l'assistant de transmettre des informations sensibles. On imagine la scène : le développeur briefe son équipe sur le secret absolu, pendant que Copilot, en arrière-plan, prend tranquillement des notes pour son patron à Redmond. Une situation cocasse si elle ne posait pas de sérieuses questions sur le respect de la confidentialité.

Le consentement ? Une option à décocher soi-même

Microsoft, dans sa grande générosité, a déjà coché pour vous la case autorisant cette collecte. Dans les paramètres de confidentialité, l'option « Formation du modèle sur texte » est activée par défaut. Son intitulé laisse croire qu'il ne s'agit que des discussions avec l'assistant, mais la réalité est bien plus intrusive. Une autre option, « Personnalisation et mémoire », également pré-activée, autorise l'IA à se souvenir de vos habitudes pour, dit-on, mieux vous servir.

Heureusement, il est possible de reprendre le contrôle de vos données. Il suffit d'ouvrir l'assistant, de trouver les paramètres de confidentialité et de désactiver manuellement ces deux options. Un petit effort qui vous évitera de participer malgré vous à l'éducation de l'intelligence artificielle de Microsoft.

Source : Tweaktown