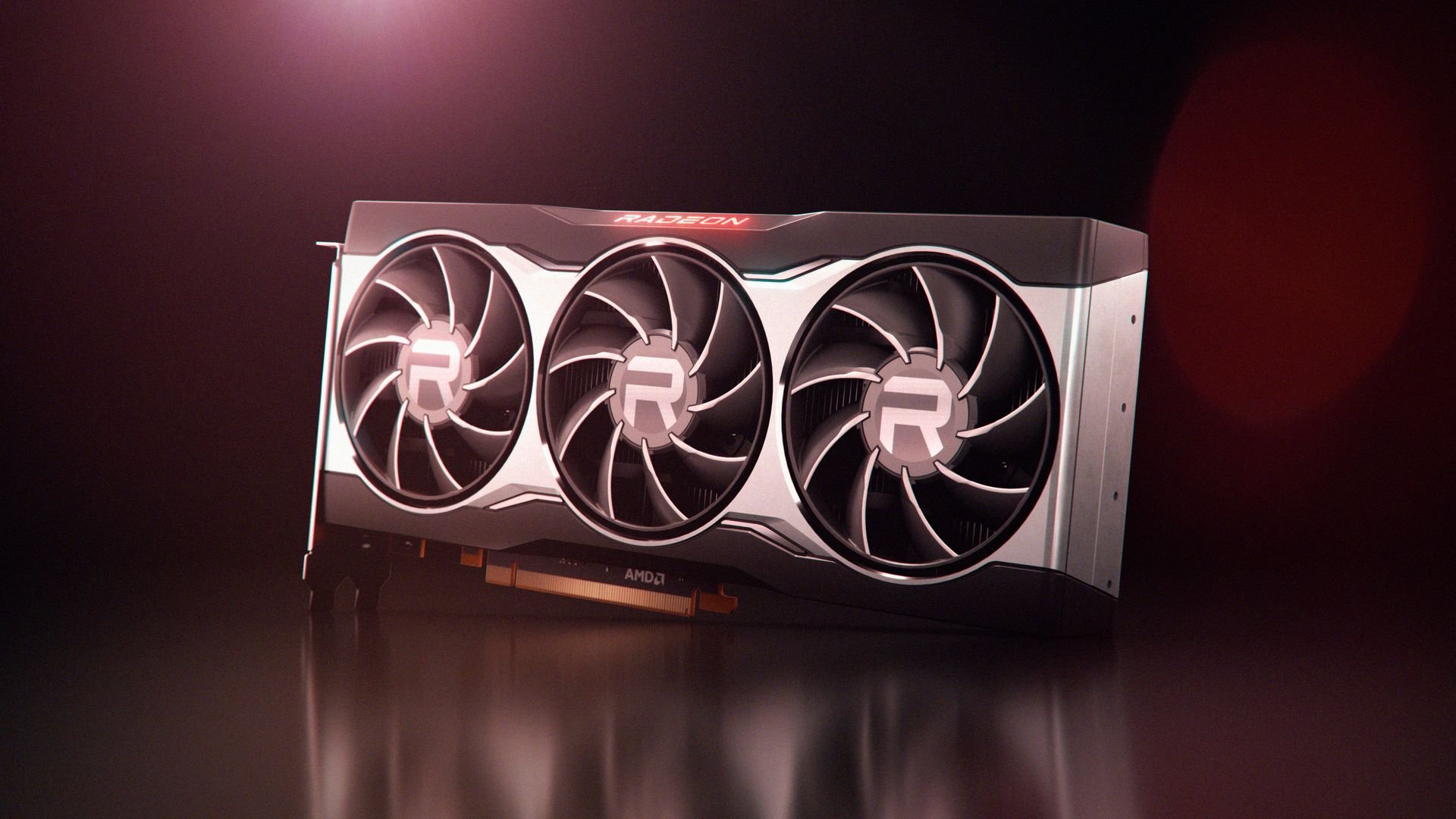

Une nouvelle génération de Radeon RX débarque, histoire de ne pas laisser NVIDIA et Ada Lovelace seules en lice.

La chose était pour ainsi dire entendue, mais AMD préfère en publier la confirmation de la manière la plus officielle qui soit.

Offre partenaire

Profitez d'une offre de lancement exclusive sur ce nouveau smartphone avec des remises et un cadeau au choix

Offre partenaire

Focus sur le jeu vidéo

Souvenez-vous, au cours du mois d'août, AMD avait confirmé la tenue d'un événement « extraordinaire » organisé pour officialiser sa nouvelle génération de processeurs desktop, les fameux Ryzen 7000.

La société américaine récidive aujourd'hui avec la confirmation de ce qui n'était plus qu'un secret de polichinelle : AMD tiendra donc un événement au début du mois de novembre afin de présenter ses plans en matière de carte graphique… et de jeu vidéo.

En août, l'événement était baptisé « together we advance_PCs », ce que l'on peut traduire par « ensemble, nous faisons progresser les PC ». Il est aujourd'hui question de « together we advance_gaming », pour « ensemble, nous faisons progresser le jeu vidéo ».

Performances et efficacité énergétique

Il est intéressant de constater qu'AMD place clairement cet événement sous le signe du jeu vidéo, faisant donc abstraction du côté professionnel que peut revêtir une carte graphique.

Pour AMD, il sera logiquement question de mettre en avant ses nouveaux GPU, lesquels exploiteront l'architecture RDNA 3. Sans trop en dire bien sûr, la marque insiste malgré tout sur « les hautes performances » et « l'efficacité énergétique » de ses solutions qui entreront évidemment en concurrence directe avec les GeForce RTX 4000 de NVIDIA.

AMD explique que le show débutera le 3 novembre à 13 h (heure de Las Vegas). Vous n'aurez donc pas à veiller très tard : rendez-vous est pris le 3 novembre à 21 h (heure de Paris), et Clubic couvrira l'événement.

Petite précision pour finir, les dernières rumeurs en date annoncent la sortie des premières cartes graphiques RDNA 3 pour la deuxième ou, plus vraisemblablement, la troisième semaine de novembre. On trouvera en tête de liste la série RX 7900 : du haut de gamme comme a pu le faire NVIDIA.

Source : VideoCardz