Capital pour ATI, le R520 est la première puce graphique à être fabriquée en 90 nm. Si le R520 est effectivement en retard, ce n'est finalement pas la faute du procédé de fabrication. En effet, les problèmes rencontrés lors de l'augmentation des fréquences provenaient, non pas d'un défaut dans le processus, mais d'une erreur de circuit passée inaperçue durant les simulations. Il aura fallu plusieurs semaines aux équipes d'ATI pour localiser le problème, engendrant le retard que l'on sait. Mais au-delà du mode de fabrication du R520, qui n'intéresse finalement que peu de monde, la nouvelle architecture d'ATI offre pour la première fois une prise en charge du Shader Model 3.0. La génération des Radeon X800, qui se base en grande partie sur les Radeon 9700 du point de vue de l'architecture, était en effet cantonnée au seul support du Shader Model 2.0. Si cela était un plus à l'époque où NVIDIA se démenait avec ses GeForce FX pour offrir un support décent du Shader Model 2.0, la firme au caméléon a renversé la vapeur avec le lancement du GeForce 6. Le GeForce 6 fut en effet le premier processeur graphique à supporter le Shader Model 3.0 par le biais de DirectX 9.0c, la dernière version en date de l'API de Microsoft.

Voilà donc la grosse nouveauté du R520 : le Shader Model 3.0 ! Mais ce n'est pas tout... ATI propose en effet avec le R520 un nouveau bus mémoire et l'intégration de la technologie Avivo dédiée à l'amélioration des fonctions purement vidéo et d'affichage. Voilà qui pourrait remettre en cause la suprématie du GeForce 7 et nous pousse évidemment à un faire un petit tour d'horizon du Radeon X1800.

Shader Model 3.0 : un passage obligé...

En extrapolant, on peut admettre que plus les shaders sont longs, plus les effets qu'ils produisent sont complexes et donc, réalistes. Avec le Shader Model 3.0, les développeurs peuvent d'ailleurs regrouper plusieurs de leurs shaders précédents en un seul, ce qui est censé, dans la théorie, accélérer les performances 3D en évitant au processeur de constamment basculer d'un shader à l'autre. Cantonné au Shader Model 2.0, qui lui a plutôt bien réussi il est vrai, ATI a dû se résoudre à embrasser le Shader Model 3.0. À cause de NVIDIA ? Pas tout à fait non, la véritable cause serait plutôt à chercher du côté de Microsoft. En effet, le géant du logiciel a souhaité mettre un terme à l'utilisation du Shader Model 2.0 et des modes de calcul en FP16 et FP24, pour passer au FP32 jugé plus précis. Mais outre la compatibilité avec DirectX 9.0c, le Shader Model 3.0 devenait une nécessité impérieuse pour ATI : les consoles de nouvelle génération que ce soit la Xbox 360, d'ailleurs équipée par ses soins, ou la Playstation 3 font toutes appel au Shader Model 3.0 et, plus important encore, Windows Vista, la prochaine version de Windows, sera dotée d'une version évoluée de DirectX 9.0 qui se basera largement sur le Shader Model 3.0. Enfin, et ce n'est pas négligeable, les développeurs de jeux ont finalement adopté assez rapidement le Shader Model 3.0, la plupart des titres du moment exploitant les subtilités de cette version. Ceci d'ailleurs de plus en plus souvent au détriment des puces ATI de type Radeon X800.

Splinter Cell: Chaos Theory : Sur ATI Radeon X800 à gauche sur NVIDIA GeForce 7 à droite

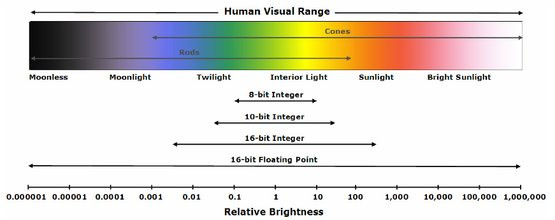

Devenu peu à peu indispensable, même si son intérêt n'est pas évident pour le commun des mortels, le Shader Model 3.0 fait donc partie intégrante de ce fameux R520, nom de code Fudo, qui équipe la nouvelle gamme Radeon d'ATI. L'intégration de ce support a demandé une refonte complète de l'architecture de la puce, par rapport à celle finalement très proche des R3xx et R4xx, respectivement Radeon 9700/9800 et X800/X850. À l'instar de NVIDIA et de ses GeForce 6 et 7, le R520 accomplit tous ses traitements internes en 32 bits. Et si nous évoquions précédemment que le mode de calcul FP32 offre une plus grande précision au niveau du traitement des couleurs, ce n'est pas la motivation première du Canadien. Au-delà de la fidélité, ATI souhaite avant tout offrir aux développeurs plus de possibilités. Mais alors quid des programmes 3D existants utilisant des shaders en FP16 ou FP24 ? Le R520 les traite en FP32 nativement sans aucune pénalité sur les performances le passage d'un format à l'autre, dans le sens ascendant, n'ayant strictement aucune incidence.

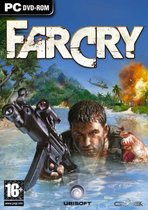

Aperçu des capacités du R520 sous DirectX 9.0c et démo ATI ToyShop

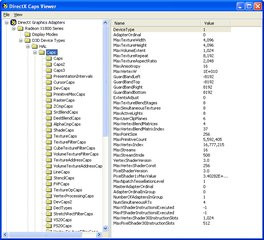

Une architecture radicalement différente

Avec le R520, ATI inaugure une toute nouvelle architecture, beaucoup plus flexible que ce que nous connaissions jusqu'alors. Par rapport aux R4xx (Radeon X800/850), ATI fait en effet un grand saut. La partie traitant les pixels au sein de la puce graphique se décompose dorénavant en divers noyaux d'exécution, dont certains, à la manière d'un jeu de construction Lego, peuvent se réadapter afin d'exécuter une tâche donnée avec le maximum d'efficacité. Pour que cela fonctionne, l'architecture du pipeline 3D a été largement revue et la notion de pixels pipelines, telle que nous la connaissions par le passé, est aujourd'hui tout simplement dépassée. Attention toutefois il n'est pas encore question d'un pipeline unifié capable de traiter aussi bien les vertex que les pixels shaders même si l'on s'en rapproche inexorablement.

Diagramme de l'architecture du R520 (Radeon X1800)

Commençons notre tour d'horizon du moteur 3D du R5xx par la partie réservée à l'exécution des vertex. Cet élément qui gère principalement les calculs géométriques comporte huit unités d'exécution et non plus six comme avec les Radeon X800. Chaque unité de vertex peut ici traiter deux instructions par cycle d'horloge ce qui confère à la puce une puissance théorique brute de 10 milliards d'instructions à la seconde. Opérant selon les spécifications du Shader Model 3.0, les unités de vertex peuvent exécuter un maximum de 1024 instructions, mais grâce au contrôle dynamique de flux le R520 peut en vérité aller beaucoup plus loin. Sans rentrer dans trop de détails, une unité de vertex du R520 se compose d'une sous unité arithmétique vectorielle de 128 bits et d'une unité scalaire de 32 bits. Petite subtilité, les unités de vertex du R5xx n'ont pas accès au moteur de textures, cette fonction n'étant pas rendue obligatoire par les spécifications du Shader Model 3.0. Du coup, cela peut poser problème et rendre les opérations de Displacement Mapping à partir des textures impossibles. ATI a ici pris soin de ne pas exposer la fonction de Displacement Mapping dans les pilotes même si elle reste fonctionnelle lorsqu'elle n'est pas liée aux textures (en utilisant un pixel shader comme point d'entrée dans les vertex shaders). Généralement c'est cette dernière variante que les développeurs utilisent, le Displacement Mapping à partir d'une texture étant trop coûteux en terme de performances.

Gros plan sur un Shader Core

Ce qui constituait autrefois le pipeline 3D est dorénavant chapeauté par un processeur multithreadé. Si ce processeur apparaît physiquement sur le schéma de l'architecture du R520, il s'agit plus d'une représentation conceptuelle que d'un véritable noyau au sein de la puce. Quoi qu'il en soit, celui-ci a pour tâche de répartir les données dans les différents Processeurs de shaders qui lui sont connectés, mais aussi dans les seize unités d'adressage de textures. Ce processeur multithreadé, baptisé Ultra-Threading Dispatch Processor, a été intégré afin d'obtenir la meilleure efficacité possible. Le crédo d'ATI étant de réduire la latence et d'éviter au maximum le gaspillage de cycles. Comme c'est le cas dans le monde des CPU, l'intérêt premier de cet « Ultra-Threading » est de paralléliser au mieux les tâches en alimentant le plus possible les autres unités de la puce. Pour cela, le R520 peut gérer jusqu'à 512 processus en parallèle (les RV515 et RV530 se contenteront quant à eux de 128 processus) et c'est précisément l'un de ses points forts.

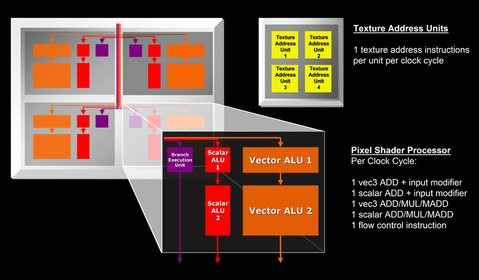

En outre, ATI offre une granularité jusqu'alors inégalée en éclatant le traitement des pixels nécessaires au rendu d'une image en un large nombre de petits processus. Avec le R520 la taille minimum d'un processus 3D peut être de 16 pixels soit un carré de 4x4. En face, le pipeline de NVIDIA travaille de manière un peu plus grossière avec une taille de threads plus élevée de 64x16. Ceci permet d'assurer une alimention quasi-perpétuelle du pipeline et si jamais l'un des cores a terminé une tâche ou est en attente de données pour achever l'exécution d'un shader, le processeur Ultra-Threading est capable de suspendre un processus en attente, jusqu'à ce que les données soient disponibles, pour faire travailler le noyau sur une autre tâche. Le processeur a également recours à un algorithme de séquencage pour réarranger le code des shaders. Dès lors le taux d'utilisation du pipeline 3D est particulièrement élevé garantissant ainsi un maximum d'efficacité. Il est également question d'accélérer le contrôle dynamique de flux grâce aux fonctions décrites précédemment et ayant trait à la gestion des processus. Rappelons que le contrôle de flux est une fonction introduite par le Shader Model 3.0 qui propose le branchement, les boucles et autres conditions dans les shaders afin, par exemple, d'exécuter une autre branche du programme en fonction du résultat obtenu. Ceci est particulièrement utile notamment pour les effets d'éclairage qui peuvent ainsi varier en fonction d'un algorithme et sans nécessité de changement de shaders. On peut encore tirer profit des branchements pour sauter certaines parties du shader qui n'ont plus besoin d'être exécutées pour telle ou telle raison.

De l'importance de la taille des processus

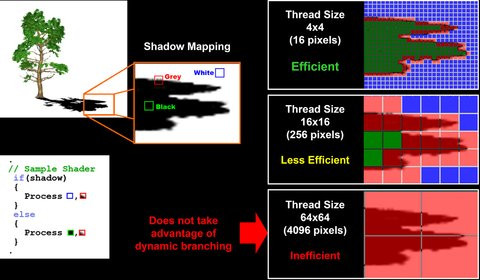

Placé en amont, le processeur multithreadé est relié à l'unité de pixels qui comporte pour sa part quatre processeurs de shaders pouvant traiter chacun quatre pixels en parallèle pour six instructions différentes par processus et par cycle d'horloge. Les quads d'ATI sont chacun munis de quatre unités arithmétiques ; deux en scalaire et deux en vectoriel en plus d'une unité de branchement. Cette dernière est une petite nouveauté dont le rôle n'est pas négligeable puisque des unités dédiées sont mises à la disposition des contrôles de flux afin de ne pas avoir d'impact sur les unités arithmétiques. Le but ? Réduire les délais liés aux opérations de branchement en permettant aux programmes qui y font appel de s'exécuter en un nombre réduit de cycles d'horloge. D'autre part, les registres à usage général du R520 sont au nombre de 32, contre 12 pour les Radeon X800 même si l'on pouvait en adresser 32 avec l'architecture R4xx. Comparativement à une architecture traditionnelle, le R520 peut donc être catalogué comme une puce disposant de 16 pixels pipelines chacun disposant de sa propre unité de texture. En fin de pipeline, on retrouve 16 unités ROP.

Un nouveau contrôleur mémoire inspiré... du Cell !

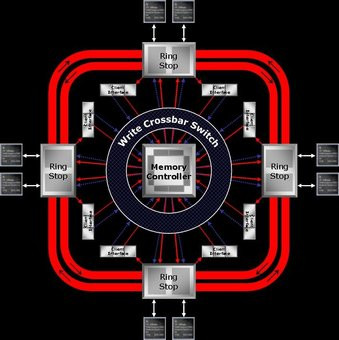

L'autre grande nouveauté du R520 est à chercher du côté de son contrôleur mémoire dont la mutation est radicale par rapport aux Radeon X800 ou même aux GeForce 6/7. ATI adopte en effet la technologie de bus mémoire circulaire de type « Memory Ring Bus » inaugurée sous une forme quelque peu différente dans le processeur Cell d'IBM. Placé au centre du VPU, ce nouveau contrôleur mémoire doit son nom au fait que les données circulent dans la périphérie de la puce pour permettre un accès plus rapide. L'avantage physique premier est de réduire la complexité des interconnexions du contrôleur mémoire au sein de la puce graphique permettant ainsi de monter plus facilement en fréquence. L'interface mémoire se décompose ainsi en deux voies de 256 bits chacune, dont l'une est réservée à la lecture et l'autre à l'écriture ce qui minimise les temps de latence. Ceci couplé au fait que les interconnexions sont moins nombreuses permet à ATI de monter facilement en fréquence mémoire, quitte à utiliser des puces mémoires dont les temps de latence sont élevés. L'architecture du Ring Bus étant capable de les masquer, cela ne pose au final pas de problème. Les opérations d'écriture en mémoire utilisent toujours un switch Crossbar et l'on distingue sur chaque paire de canal mémoire des points d'arrêt dit « Ring Stop ». Il s'agit ici de connecter le bus aux puces mémoires ; du coup lorsqu'un client effectue une requête, le contrôleur mémoire détermine quelle puce DRAM peut y répondre, oriente la requête vers la DRAM concernée, puis les données issues de la puce sont placées sur le bus pour atteindre le point d'arrêt le plus proche du client à l'origine de la requête.

Schéma du contrôleur mémoire Ring

Grâce à ce nouvel agencement, le contrôleur mémoire est capable de prioriser les demandes en fonction de l'impact qu'elles auront sur les performances, le comportement du bus étant prédictible. Pour ses arbitrages, le contrôleur mémoire se base notamment sur le poids des clients, que l'on peut paramétrer via l'application, afin de savoir qui sera servi en premier. Avec la précédente génération de puces Radeon, une toute petite partie du contrôleur mémoire pouvait être mise à jour via les pilotes. Grâce à sa nouvelle architecture, ATI a pris soin de se ménager une marge de manœuvre confortable puisque l'intégralité des algorithmes en charge de l'arbitration du contrôleur mémoire peut être mis à jour par le seul biais des pilotes, sans changement de BIOS donc. En parallèle, ATI a également amélioré ses algorithmes Hyper Z avec une compression plus efficace et un HSR amélioré. Rappelons que le HSR, ou Hidden Surface Removal, consiste à déterminer quels éléments d'une scène pourraient être cachés par d'éventuels objets au premier plan afin de ne pas s'embêter avec leur rendu et gagner en performance. Ici, ATI utilise une nouvelle technique en virgule flottante pour plus de précision et annonce un gain de 60 % face au Radeon X850. Les Drivers caches ont également fait l'objet d'attentions particulières de la part d'ATI, puisqu'ils sont dorénavant totalement associatifs et peuvent accéder à n'importe quelle partie de la mémoire, alors qu'ils devaient jusqu'alors se contenter d'accéder à certaines portions bien délimitées de la mémoire. Comme si tout cela ne suffisait pas, le contrôleur mémoire du R520 est déjà prêt pour la DDR4 et affiche une bande passante théorique maximale de 48 Go/s.

Des améliorations variées pour une image toujours plus belle

Au-delà des changements de l'architecture, ATI profite du R520 pour introduire quelques nouvelles fonctions. La plus flagrante, qui découle du support du Shader Model 3.0, est bien sûr l'inclusion totale du fameux HDR. Pour ceux qui ne seraient pas encore au courant, le HDR, ou High Dynamic Range, est un effet visuel qui permet d'obtenir de saisissants effets d'éclairage notamment lorsque dans un jeu, vous regardez le ciel ou le soleil. À vrai dire, le HDR n'est pas nouveau chez ATI puisqu'il existait déjà avec la série des Radeon 9x00, simplement l'arrivée de l'architecture R5xx permet d'offrir des effets beaucoup plus précis. Et pour cause puisque chaque composante peut être calculée avec une précision de 10 bits. Mieux, il est également possible de faire appel à des composantes en FP16, comme sur les GeForce 6/7, chose qui n'était pas possible auparavant sur les Radeon X800. Le recours à des calculs en virgule flottante permet d'avoir un champ d'action plus important et ATI l'a bien compris. Visuellement, l'apport du HDR change généralement l'expérience d'un jeu et même si avec certains titres l'effet est parfois un peu exagéré, le HDR demeure un plus indéniable. Au niveau de la compatibilité des jeux faisant appel au HDR et utilisant l'implémentation de NVIDIA, il est possible que certains titres puissent ne pas fonctionner avec le Radeon X1800XL, il faudra dans ce cas attendre sagement l'arrivée d'un patch. C'est le cas de Far Cry qui nécessitera le patch 1.4 pour supporter le HDR à la sauce ATI alors que Day Of Defeat Source lui supporte déjà le HDR grâce à la dernière mise à jour du Source Engine.

De l'intérêt du HDR en FP16...

Mais au-delà de l'implémentation désormais totale du HDR, ATI propose l'antialiasing avec le HDR ! C'est une première, car chez NVIDIA cela n'est pas possible ni avec les GeForce 6, ni avec les GeForce 7. Avec le R520 il devient donc possible de profiter non seulement du HDR 64 bits (4 composantes de 16 bits en virgule flottante), mais également d'un anticrénelage de type MultiSampling. En plus de cela, le HDR peut bénéficier des fonctions de compression de texture qu'offre ATI avec son 3DC. Autre nouveauté introduite par la nouvelle architecture d'ATI, l'Adaptative Anti-Aliasing. Ici, ATI n'innove pas vraiment et se contente en fait de suivre son concurrent NVIDIA. En effet, avec le GeForce 7, NVIDIA introduisait une fonctionnalité de Transparent Antialiasing. Il s'agit ici de détecter les objets simulés générés depuis des textures ayant un canal Alpha (en transparence donc) afin de leur appliquer un filtre qui prévient les effets d'escaliers que l'on observe généralement sur des grillages, barrières, feuilles et autres objets de cette nature qui sont en transparence. Lorsque ce type d'objet est détecté, un anticrénelage en SuperSampling est appliqué à la place du Multisampling.

Un exemple de l'apport de l'Adaptative AA : à gauche sans, à droite avec (observez la rampe)

En ce qui concerne les fonctions d'anticrénelage, on retrouve dans le R520 le temporal antialiasing introduit avec les Radeon X800 et toujours exclusif aux cartes ATI. Les utilisateurs continueront de profiter du mode d'anticrénelage en 6x, déjà présent dans les Radeon X800, et ATI introduit un tout nouveau filtrage des textures. Le but étant d'offrir des textures plus nettes, plus claires, lorsqu'elles passent le filtrage anisotropique. ATI a pour cela développé une méthode plus sophistiquée pour déterminer les échantillons de texture requis pour chaque pixel. Puisque l'on parle de textures sachez que les textures hautes résolutions, 4096x4096 sont également supportées, mais cela n'a rien de véritablement révolutionnaire.

Qualité d'image : à gauche ATI Radeon X1800 XT en filtrage AF 8x haute qualité, à droite GeForce 7800 GTX en filtrage AF 8x (observez bien l'eau)

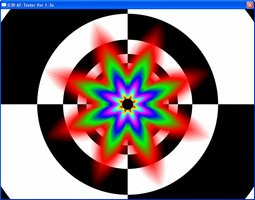

À gauche : filtrage anisotropique 8x normal, au centre : filtrage anisotropique 8x haute qualité, à droite : filtrage anisotropique chez NVIDIA

Enfin, la fonction de compression des textures, le 3DC, introduite initialement avec les Radeon X800, passe ici en version 3DC+. Il s'agit toujours de compresser les textures avec le minimum de perte de qualité et la nouveauté vient du support des textures simple canal qui se voient appliquées une compression avec un ratio 2:1. Si le 3DC n'a pas encore été massivement adopté par les développeurs, Serious sam 2, qui ne saurait tarder, devrait en tirer parti et il se murmure que Microsoft intégrera la fonction de compression des normal maps dans la prochaine version de DirectX.

Avivo : circulez, il n'y a pas grand-chose à voir...

Pour le reste, le pipeline d'affichage d'Avivo propose des fonctions relativement standard de post-process avec correction gamma, correction de couleur et mise à l'échelle. Rien de véritablement nouveau sous le soleil donc et ce n'est pas non plus l'implémentation d'Avivo dans les pilotes qui nous convaincra d'autre chose. En effet, on retrouve quasiment les mêmes fonctions vidéo qu'ATI propose depuis plusieurs mois déjà et seul le nom a changé avec la mention Avivo qui apparaît dans le Control Center. ATI propose tout de même quelques nouveautés comme le support du 2:2 et du 3:2 pulldown, alors que l'assistance au décodage est toujours de la partie pour les MPEG2 et autres WMV9. Seul problème, cette dernière fonction est largement bugguée et en pratique l'accélération matérielle DXVA de la lecture des WMV9 HD provoque l'apparition d'un tas d'artefacts sur la vidéo... Pas très convaincant donc et si ATI corrigera sans doute le bug, on espère que cela arrive vite. Plus généralement, l'architecture R5xx devrait prochainement offrir une assistance au décodage des flux H.264, mais ATI annonce également que l'encodage vidéo sera également assisté par le VPU. Seul détail, cette fonction s'appuie en partie sur les puces Rage Theater. Il faudra donc attendre l'arrivée du Rage Theater 600 pour profiter pleinement de ces accélérations lors des opérations d'encodage vidéo.

ATI CrossFire

ATI R520 : la puce

Gros plan sur la puce et la mémoire

Non content d'avoir profondément revu l'architecture de ses puces Radeon, ATI a également revu son interface PCI-Express. Le Canadien a ici concentré ses efforts sur l'amélioration du contrôleur PCI-Express 16x afin que celui-ci délivre des performances plus importantes. On distingue ici trois améliorations principales : les transferts du VPU vers la mémoire système en écriture sont 50 à 100 % plus rapides, les lectures depuis la mémoire système vers le VPU sont améliorées de 20 % et l'écriture dans la mémoire vidéo par le CPU est également plus rapide.

| NVIDIA GeForce 7800 GTX | ATI Radeon X850 XT PE | ATI Radeon X1800 XL | ATI Radeon X1800 XT | |

| Interface | PCI-Express 16x natif | PCI-Express 16x natif | PCI-Express 16x natif | PCI-Express 16x natif |

| Gravure | 0,11 µ | 0,13 µ low-k | 0,09 µ | 0,09 µ |

| Transistors | ~302 Millions | ~180 Millions | ~320 Millions | ~320 Millions |

| Ramdac | 2 x 400 MHz | 2 x 400 MHz | 2 x 400 MHz | 2 x 400 MHz |

| T & L | DirectX 9.0c | DirectX 9.0b | DirectX 9.0c | DirectX 9.0c |

| Pixel Pipelines | 24 | 16 | 16 | 16 |

| Vertex Pipelines | 8 | 6 | 8 | 8 |

| Mémoire embarquée | 256 Mo | 256 Mo | 256 Mo | 512 Mo |

| Interface mémoire | 256 bits | 256 bits | 512 bits | 512 bits |

| Bande passante mémoire | 38,4 Go/s | 37,7 Go/s | 32 Go/s | 48 Go/s |

| Fréquence GPU | 430 MHz | 540 MHz | 500 MHz | 625 MHz |

| Fréquence mémoire | 600 MHz | 590 MHz | 500 MHz | 750 MHz |

Les cartes Radeon X1800

Dans sa version XL, le X1800 adopte un design simple slot dont le PCB huit couches est toutefois plus long que celui des précédentes générations d'ATI. J'en veux pour preuve que la carte mesure 22,6 cm de long contre un peu plus de 18,5 cm pour les Radeon X800/850. La version reçue du X1800 XL était ici pourvue de 256 Mo de mémoire GDDR3 sous la forme de puces Samsung certifiées à 1,4 ns. Disposant d'un connecteur d'alimentation PCI-Express, la carte embarque un système de refroidissement semblable à celui des Radeon X800 XL. Il s'agit d'un radiateur en cuivre qui repose sur le VPU et les puces mémoires, via des pads thermiques. Muni en son extrémité d'un ventilateur le tout est encastré dans une coque d'aluminium frappée de l'image de Ruby, l'égérie d'ATI. Le ventilateur ajuste sa vitesse de rotation en fonction de l'échauffement de la puce et ici ATI nous déçoit puisque le Radeon X1800XL est bruyant, du niveau de celui équipant les designs de référence du GeForce 7800 GT, ce qui est loin d'être une comparaison flatteuse. Par ailleurs et comme sur les GeForce 6/7, l'étage d'alimentation de la carte est recouvert d'un petit radiateur fuchsia. ATI dote son 1800 XL d'un composant VIVO, par le biais d'une puce Rage Theater qui date sérieusement. Le processeur graphique intégrant deux TMDS, ATI n'utilise aucun composant externe et propose deux sorties DVI en plus de la sortie vidéo.

Carte ATI Radeon X1800 XL

Pour son modèle haut de gamme, le Radeon X1800XT, ATI a opté pour un design double-slot. La carte, dont la longueur est identique au modèle XL, se voit pourvue du même système de refroidissement que celui des Radeon X850 XT. Bien sûr, quelques adaptations ont été faites de-ci, de-là. À commencer par le radiateur en cuivre qui est plus long. Reposant sur les puces mémoires via des pads thermiques et sur le processeur graphique, le système de refroidissement est encastré dans un carénage de plastique au centre duquel tourne un ventilateur rouge, chargé d'expulser l'air chaud à l'extérieur de la carte. À l'instar du système équipant les Radeon X850 XT, celui du X1800 XT est bruyant et se fait entendre dès le démarrage de la machine. Fort heureusement, sa vitesse est par la suite ajustée, à la baisse, ce qui devrait être un vrai bonheur pour vos oreilles. Le modèle XT est lui aussi pourvu d'une puce Rage Theater et voit également son alimentation électrique confiée à un connecteur additionnel alors que l'étage d'alimentation de la carte est refroidi par un radiateur dédié. Les puces mémoires sont toujours signées Samsung, mais sont ici certifiées à 1,2ns. Alors qu'ATI a choisi de cadencer la mémoire à 1,5 GHz, soit 750 MHz, les puces peuvent encaisser 800 MHz soit 1,6 GHz d'après les spécifications officielles de Samsung. En fonctionnement, il faut avouer que la carte, ici aussi munie de deux sorties, s'échauffe assez rapidement du fait de ses fréquences élevées.

Carte ATI Radeon X1800 XT

Le Control Center : décidément, ce n'est toujours pas ça...

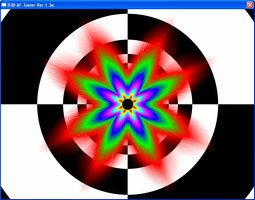

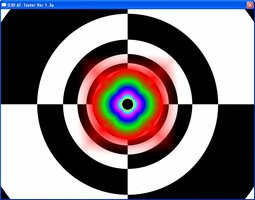

Alors qu'ATI lance sa nouvelle architecture, la dernière évolution des pilotes Catalyst est loin d'être convaincante. En effet, de nombreux bugs persistent dans cette version intermédiaire et, outre le problème d'accélération des WMV9 HD, de multiples problèmes ont ralenti nos tests. Le plus spectaculaire après le problème vidéo étant celui du mode de filtrage haute qualité des textures qui bien qu'il soit coché dans les pilotes n'est pas toujours actif ou inactif. Il suffit d'un simple détour sous AF Tester pour s'en convaincre. D'autres bugs aléatoires posent, de temps à autre, problème avec des redémarrages volontaires de Windows qui se soldent par l'affichage d'un écran blanc ou alors des bugs surprenants sous Doom 3 où l'exécution d'un test en 1600x1200 avec FSAA 4x et Anisotropic Filtering 8x se termine parfois par l'apparition d'une constellation à l'écran. On passera sous silence, ou presque, le problème d'affichage de l'écran de démarrage de notre A8N, totalement corrompu, ou bien encore la fréquence mémoire erronée remontée par les pilotes pour le X1800 XT (96 MHz)... Il est important de souligner que l'usage du Control Center est obligatoire si l'on veut profiter des fonctions de type High Quality AF ou Adaptative AA... Par ailleurs et bien qu'ATI le mentionne dans ses présentations la fonction OverDrive est aux abonnés absents... Bref, le Catalyst Control Center reste donc une plaie de par ses moult bugs et sa lenteur affligeante.

Pilotes ATI Catalyst Control Center

- Carte mère Asus A8N-SLI Deluxe,

- Processeur AMD Athlon 64 FX-57,

- 2x512 Mo Corsair TwinX 3200 XL Pro,

- Disque dur Western Digital Raptor 36 Go Serial-ATA 150

AquaMark 3.0

On commence par notre bon vieux AquaMark 3.0 qui place le GeForce 7800 GTX en tête des graphiques. Toutefois le Radeon X1800 XT n'est vraiment pas loin et il n'a pas à rougir. Le Radeon X1800 XL affiche ici des performances à égalité avec le Radeon X850 XT PE, l'ancienne offre haut de gamme d'ATI. Face au Radeon X1800 XL, le modèle XT est ici 13% rapide. Radeon X1800 XL qui est lui même 14% plus véloce que notre Radeon X800 XL de référence.

Unreal Tournament 2003

Bien que vieillissant Unreal Tournament 2003 reste intéressant dans la mesure où son moteur graphique est encore exploiter par divers jeux. Ici le Radeon X1800 XT est largement en tête, le GeForce 7800 GTX étant tout simplement désarmé. En 1600x1200 l'avantage du Radeon X1800 XT s'élève à 7% sur le GeForce 7800 GTX. Face au Radeon X850 XT PE, le Radeon X1800 XT est ici 28% plus véloce. On notera au passage que le Radeon X1800 XL fait ici mieux que le X850 XT PE mais moins bien que le GeForce 7800 GTX.

3DMark 2005

Sous 3DMark 2005 le Radeon X1800 XT mène largement la danse. Le gain face au GeForce 7800 GTX atteint ici 12%, mais la dernière puce graphique à la mode de NVIDIA conserve un train d'avance sur le Radeon X1800 XL. Radeon X1800 XL qui est lui-même 12% plus performant que le Radeon X850 XT PE.

Doom 3

Doom 3 plaide sans surprise en faveur du GeForce 7 de NVIDIA. Ici le modèle GTX se montre 33% plus performance que le Radeon X1800 XT. Il faut dire qu'ATI n'a pas fait beaucoup d'effort sur le support OpenGL : la réécriture des pilotes OpenGL promise à la sortie de Doom 3 n'est toujours pas achevée... Bref les qualités intrinsèques du Radeon X1800 XT font que celui-ci est tout de même 41% plus rapide que le Radeon X850 XT PE. C'est toujours ça de pris !

Far Cry v1.33

Sous Far Cry nous aurions bien voulu faire appel aux effets HDR que permettent les architectures NVIDIA et ATI. Hélas la fonction n'est pas encore opérationnelle chez ATI et il faudra attendre le patch 1.40. En attendant on se contente d'exécuter Far Cry en mode Shader Model 3.0 sur toutes les cartes et ici le GeForce 7800 GTX conserve un léger avantage sur le nouveau bébé d'ATI : de l'ordre de 3,5%. L'écart de performances entre le Radeon X1800 XT et son petit frère le XL atteint ici 13% ce qui reste conséquent. Du coup le Radeon X850 XT PE est plus rapide en 1600x1200 que le Radeon X850 XT PE.

BattleField 2

Assez récent Battlefield 2 fait la joie de nombreux joueurs malgré quelques déboires dans la gestion des serveurs notamment. Pour ce qui nous intéresse le GeForce 7800 GTX reste nettement plus performant sous BattleField 2 que le Radeon X1800 XT, mais le framerate obtenu est tellement démesuré que cela ne saurait être considéré comme véritablement significatif. On constate toutefois que le Radeon X850 XT PE fait ici mieux que le tout nouveau Radeon X1800 XT et l'écart entre le modèle XT et le XL se monte à 40%.

Splinter Cell: Chaos Theory

On enchaîne avec l'ami Sam Fisher. GeForce 7800 GTX et Radeon X1800 XT, qui tournent toutes deux en Shader Model 3.0 sont ici à égalité quasi parfaite. Une fois de plus le Radeon X1800 XL marque le pas face au X850 XT PE, même s'il demeure 23% plus performant que son prédécesseur le Radeon X800 XL.

Half-Life 2

Avec la toute dernière mise à jour du Source Engine, Half-Life 2 nous oblige à une fois de plus recréer notre propre démo personnalisée, ce que nous avons fait. Le Radeon X1800 XT l'emporte ici sur le GeForce 7800 GTX mais l'écart reste mesuré. Ainsi en 1600x1200 le Radeon X1800 XT est 3% plus performant que la dernière puce du caméléon. Le Radeon X1800 XL s'affiche ici comme plus performant que le Radeon X850 XT PE, alors que son framerate est 6,5% supérieur à celui d'un Radeon X800 XL.

F.E.A.R.

Tout récent F. E. A. R. est particulièrement gourmand. Cela se ressent très nettement puisqu'en 1600x1200, toutes options activées, le GeForce 7800 GTX ne dépasse pas les 27 FPS. Face au GeForce 7 le Radeon X1800 XT est largement plus performant, en partie grâce à ses 512 Mo de mémoire qui l'aide sensiblement vu la taille parfois élevée des textures. F. E. A. R. est ici 29% plus rapide avec le Radeon X1800 XT qu'avec le GeForce 7800 GTX. On note qu'en 1600x1200 le GeForce 7800 GTX est à égalité avec le Radeon X1800 XL. Ce dernier demeure 19% plus rapide que le Radeon X850 XT PE et 51% plus performant que le Radeon X800 XL.

Far Cry v1.33 - FSAA 4x & Aniso 8x

On retourne sous Far Cry en activant cette fois-ci les fonctions d'anticrénelage. Notez que dans les pilotes ATI nous utilisons systématiquement le filtrage anisotrope haute qualité alors que nous réglons les pilotes NVIDIA sur le mode Haute Qualité. Malgré la similitude dans l'appellation de la fonction, la qualité du filtre d'ATI n'a pas grand chose de commun avec celle de NVIDIA. Ici le Radeon X1800 XT se détache assez sensiblement du GeForce 7800 GTX et en 1600x1200 la dernière puce d'ATI est jusqu'à 34% plus performante. Du coup le Radeon X1800 XL fait ici aussi bien que le GeForce 7800 GTX tandis que le Radeon X850 XT PE est en embuscade.

Half-Life 2 - FSAA 4x & Aniso 8x

Sous Half-Life 2 et dans les mêmes conditions le Radeon X1800 XT conserve son avantage sur le GeForce 7800 GTX. Avantage qui s'établit à 6% en 1600x1200, alors que le Radeon X1800 XL fait une fois encore jeu égal avec le Radeon X850 XT PE. Par rapport au X1800 XL, le X1800 XT est 13% plus performant.

Doom 3 - FSAA 4x & Aniso 8x

L'activation des fonctions d'anticrénelage sous Doom 3, si elle s'avère handicapante pour toutes les puces graphiques, laisse notre GeForce 7800 seule en tête. En 1600x1200 ses performances sont 33% supérieures au Radeon X1800 XT. Ce dernier ne brille d'ailleurs guère dans cette résolution puisque son avantage face au Radeon X850 XT PE n'est que de 7%. Face au X1800 XL, le XT est 19% plus véloce.

Splinter Cell : Chaos Theory - FSAA 4x & Anisotropic Filtering 8x

Rebelote avec Splinter Cell : Chaos Theory : malgré l'activation du FSAA 4x et de l'AF 8x, GeForce 7800 GTX et Radeon X1800 XT sont à égalité. Le Radeon X850 XT PE fait ici jeu égal avec le X1800 XL, alors que le X1800 XT affiche des performances 30% supérieures au X1800 XL.

BattleField 2 - FSAA 4x & Anisotropic Filtering 8x

A l'inverse du test sans FSAA/AF, le Radeon X1800 XT est ici outrageusement en tête et pulvérise le GeForce 7800 GTX. Il s'avère orès de 53% plus performant en 1600x1200 ! Du coup même le Radeon X1800 XL fait mieux que la dernière puce de NVIDIA, même si le Radeon X850 XT PE est très légèrement devant le XL. Ici l'écart entre le très haut de gamme d'ATI, représente par le Rdeon X1800 XT, et le haut de gamme, c'est à dire le X1800 XL, se mesure à 41%.

Half-Life 2 - FSAA 4x, Anistropic Filtering 8x & Transparent AA

On termine par un tour d'horizon des performances en anticrénelage sous Half-Life 2 lorsque le Transparent AA est activé aussi bien chez NVIDIA que chez ATI. Le X1800 XT conserve ici la tête, avec un framerate 7% supérieur au GeForce 7800 GTX en 1600x1200. Néanmoins le Radeon X1800 XL reste en retrait face au GeForce 7800 GTX qui est dans ces conditions 7% plus rapide.

Conclusion

En définitive, l'arrivée du Shader Model 3.0 permet à ATI de se remettre à niveau en offrant le support du fameux HDR, de plus en plus à la mode, mais aussi des fonctions de type Paralax Occlusion Mapping. Non content de supporter le HDR 64 bits, ATI inflige un camouflet à NVIDIA en offrant le support de l'anticrénelage en HDR, chose qui n'est pas possible avec les GeForce 7. ATI ne s'est pas arrêté en si bon chemin et en a profité pour introduire tout un tas de petites nouveautés avec un mode de filtrage amélioré et une évolution du 3DC. Bref, le Radeon X1800, malgré son retard évident, ne déçoit pas. Enfin presque... Car les divers bugs des pilotes sont franchement pénibles et le design des cartes n'est pas forcément des plus séduisants. Le Radeon X1800 XT occupe deux slots, et si le XL est moins encombrant il est aussi très bruyant, trop bruyant. Malgré tout et sachant que le renouveau d'une architecture n'est pas une mince affaire, le Radeon X1800 est plutôt convaincant avec de bonnes performances et une bonne marge de progression via de futures mises à jour des pilotes.

Reste un souci, un détail, une peccadille, non, non je ne reviendrai pas sur les bugs des pilotes que nous espérons vite voir disparaître, mais sur le prix et la disponibilité. ATI annonce un prix de 499 dollars pour le Radeon X1800 XT 256 Mo et 549 dollars pour le modèle XT avec 512 Mo, le modèle XL ne coûtant lui « que » 449 dollars en version 256 Mo. Du côté des disponibilités ATI annonce que son X1800 XL est disponible dès aujourd'hui alors que le X1800 XT est prévu pour le 5 novembre, très précisément. D'après nos sources chez divers constructeurs si les premières livraisons Radeon X1800 XL devraient démarrer dans les deux semaines à venir, le modèle XT est loin d'être disponible et nous émettons quelques réserves quant à sa disponibilité prochaine.

Cet article vous intéresse ? Retrouvez-le dans le comparateur de prix de Clubic.com

Commentaires (0)

Poster mon commentaire