Alors qu'OpenAI vient tout juste de lancer Atlas, son navigateur propulsé par ChatGPT, l'Electronic Frontier Foundation alerte : ce nouveau produit représente une menace sans précédent pour la vie privée des utilisateurs.

OpenAI a déployé cette semaine Atlas, son navigateur web intégrant ChatGPT. L'outil promet une navigation assistée par intelligence artificielle, comme Comet chez Perplexity ou Opera Neon. Mais au regard de la popularité de ChatGPT, les porte-paroles de l'Electronic Frontier Foundation se sont mobilisés pour dégainer vite et faire la lumière sur les pratiques du géant de l'IA. Victoria Noble et Lena Cohen, techniciennes à l'EFF, tirent la sonnette d'alarme sur les pratiques de collecte de ce nouveau produit.

Plus qu'un historique, un système de mémoire

Atlas ne se contente pas d'enregistrer les URL visitées comme le fait un navigateur traditionnel. Interrogée par ABC, Victoria Noble explique que l'application d'OpenAI stocke des "souvenirs" du contenu consulté sur chaque page web. Concrètement, le système analyse et mémorise des informations précises : vos préférences de voyage, la compagnie aérienne que vous utilisez, votre calendrier en ligne. Ces données sont traitées sur les serveurs d'OpenAI sous forme de résumés, ce qui permet à ChatGPT de personnaliser ses réponses en fonction de votre activité de navigation.

Cette fonctionnalité dépasse ce que propose actuellement Chrome avec Gemini. Le navigateur de Google ne permet pas à son assistant IA de stocker des souvenirs basés sur le contenu des pages web. Gemini peut uniquement répondre à des questions sur l'historique de navigation si l'utilisateur le demande explicitement.

"On ne sait pas vraiment comment ils stockent ces données, comment ils filtrent les informations personnelles (...) et pour les utilisateurs, il est très difficile de mesurer la quantité de données collectées", affirme Mme Noble.

Des failles dans la protection des données sensibles

L'EFF a mené des tests, lesquels révèlent des dysfonctionnements jugés très préoccupants. Atlas est censé ne pas mémoriser les identifiants gouvernementaux, les numéros de compte bancaire, les mots de passe ou les dossiers médicaux. Pourtant, lors d'un test, le navigateur a conservé en mémoire des informations relatives à une inscription à un planning familial, ainsi que le nom d'un médecin réel.

Dans un entretien recueilli par le Washington Post, Lena Cohen qualifie cette collecte extensive de "cauchemar potentiel pour la vie privée". Les implications sont d'autant plus sérieuses que ces données pourraient être demandées par les autorités, notamment pour des activités légales dans certains États mais pas dans d'autres, comme l'avortement.

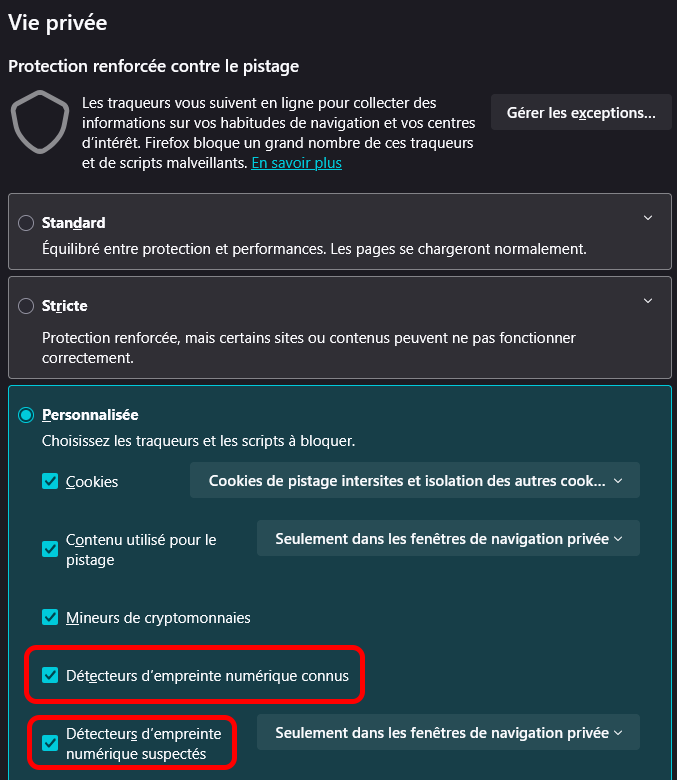

Des contrôles complexes et dispersés

OpenAI propose plusieurs options pour gérer les souvenirs d'Atlas, mais, à l'instar des paramètres continuellement opaques chez Facebook, la tâche ne serait pas vraiment rendue facile. Les utilisateurs peuvent demander au navigateur d'ignorer certains sites via la barre d'adresse. Il peuvent effacer les souvenirs en supprimant l'historique, ou consulter et supprimer individuellement les mémorisations dans les paramètres. Cependant, ces souvenirs sont stockés séparément de ceux que ChatGPT accumule déjà sur les utilisateurs : la gestion de ses données personnelles devient alors très complexe.

Quant au mode incognito, il n'empêche pas ChatGPT lui-même d'accéder aux informations de navigation. Adam Fry, responsable produit d'Atlas chez OpenAI, assure que les souvenirs servent uniquement à améliorer les fonctionnalités du navigateur et ne sont pas utilisés pour entraîner les modèles d'IA par défaut. L'entreprise n'a pas d'activité publicitaire, précise-t-il, avant d'ajouter : "Pour l'instant".